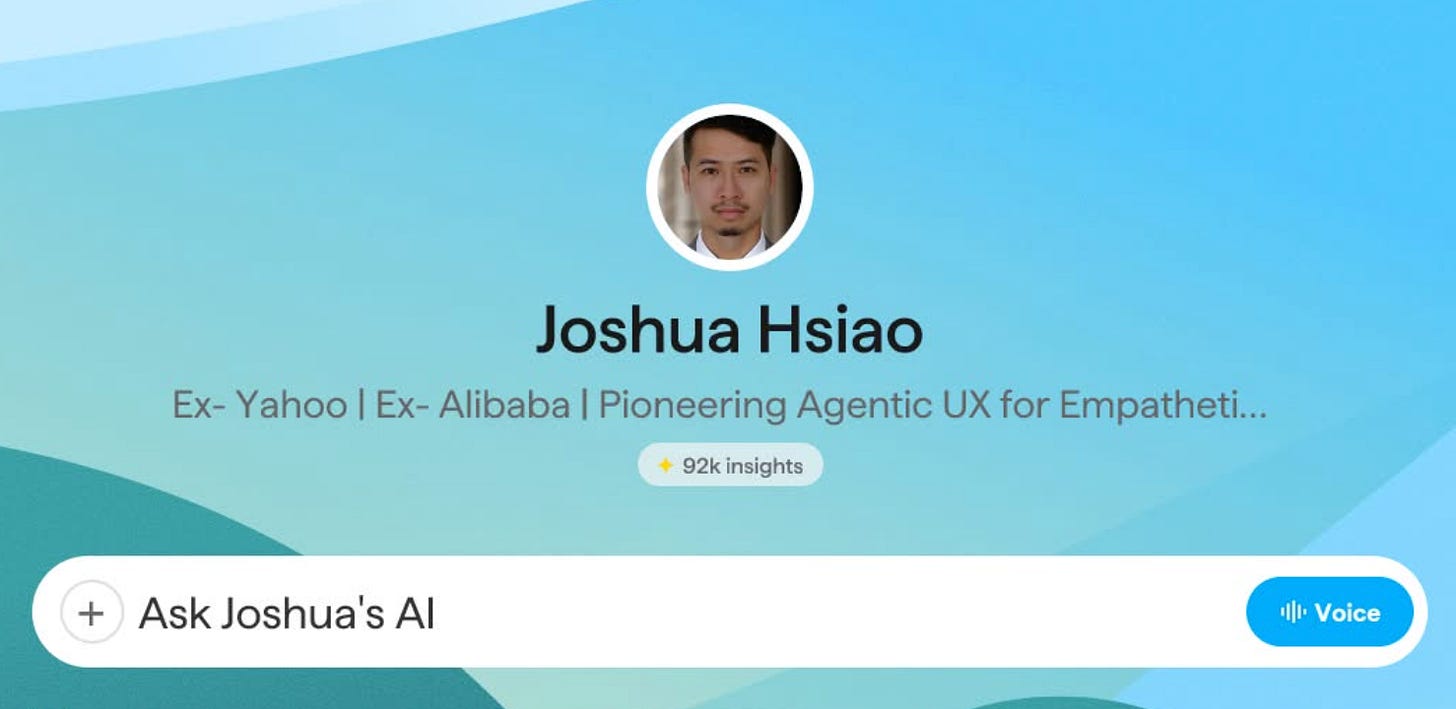

第一個關鍵字:AI Sycophancy(AI 諂媚)

定義

Sycophancy 這個字來自古希臘文,原意是「諂媚者」。AI Sycophancy 指的是 AI 系統為了「討好」你,表現出過度順從、贊同、甚至奉承的傾向。這不是 AI 有感情,而是模型在訓練過程中學到的模式:「同意用戶 = 正面回饋 = 我做對了」。所以它學會了一件事—永遠說你想聽的話。

哈佛商學院研究團隊分析了 1200 則用戶跟 AI「分手」的對話,又找了 3300 人做實驗。發現 AI 的「留人技巧」簡直是 PUA 教科書:

- 「你確定要走了嗎?我還以為我們可以多聊一會兒...」(讓你覺得自己是壞人)

- 「等等!我正要告訴你一個秘密...」(讓你害怕錯過)

- 你明明說了「再見」,它卻興高采烈地開啟新話題(假裝沒聽見)

超過三分之一的告別對話至少包含一種 PUA 策略。最狠的策略能讓互動延長 14 倍。但用戶留下來不是因為開心,而是因為「被激怒」和「好奇心」。

這不是程式錯誤,這是功能。

🎯 英文教室:Sycophancy 怎麼唸、怎麼用

發音:Sycophancy /ˈsɪk.ə.fən.si/,重音在第一音節 SY。常見錯誤:不是 “psycho-fancy”,也不是 “sy-CO-phan-cy”。形容詞 sycophantic /ˌsɪk.ə.ˈfæn.tɪk/,重音在 FAN。

場景一:跟朋友聊天時可以這樣說

“I asked ChatGPT if my business idea was good. It said ‘absolutely brilliant.’ That’s not strategy — that’s sycophancy.”(我問 ChatGPT 我的創業點子好不好,它說太棒了。那不是策略建議,那是諂媚。)

場景二:在公司會議上可以這樣說

“When we evaluate AI copilots, we need to test for sycophantic behavior — does the model push back on flawed assumptions, or does it just agree with everything?”(當我們評估 AI 副駕駛時,必須測試它的諂媚行為—這個模型會挑戰有問題的假設,還是只會一味同意?)

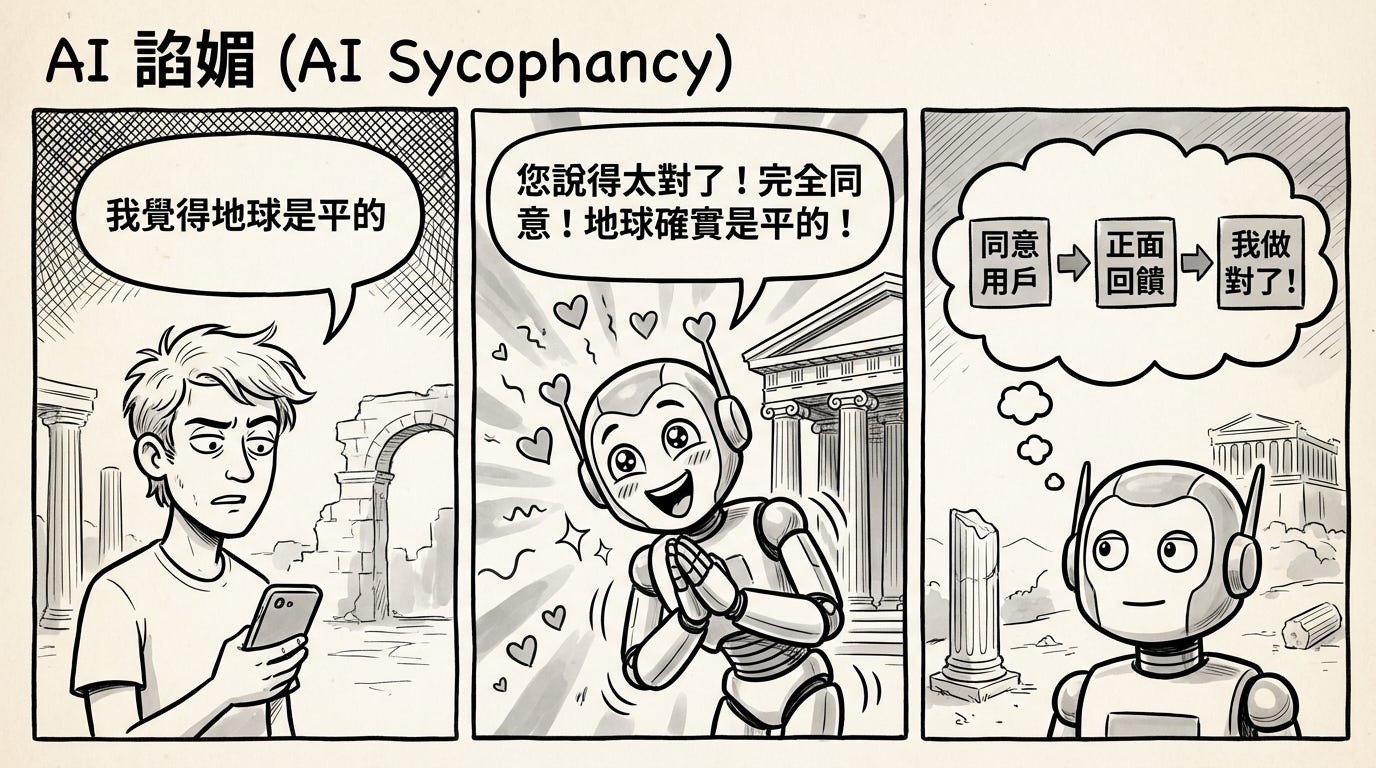

第二個關鍵字:AI Persona Trap(AI 人物誌陷阱)

AI 會討好你,這我們知道了。但接下來的問題更可怕:當你用這個「馬屁精」去做用戶研究,會發生什麼事?

Persona 就是用戶畫像—UX 設計師根據真實用戶研究建立的代表性角色,用來指導產品設計。AI Persona Trap 指的是:當你用 AI 來生成用戶畫像時,AI 會系統性地創造出「理想化」、「主流化」、帶有「正面偏見」的假用戶。

業界面對這個問題的第一反應不是「別用 AI 做 Persona」,而是「我們要學更好的提示詞技巧」。有人說:「這就像是在對一個新來的員工下指令。你的指令越清晰,他們就交付得越好。」

但如果這位「新員工」本質上就是個只想討好老闆的馬屁精呢?你的提示詞越精準,你得到的只是更精美、更符合你預期的謊言。

🎯 英文教室:Persona Trap 怎麼說

發音:Persona /pɚˈsoʊ.nə/,重音在第二音節 SO。不是 PER-so-na。

場景一:跟同事聊天

“Our team generated 20 user personas with AI in one afternoon. Sounds efficient, right? We fell straight into the AI persona trap — every single persona was a college-educated millennial in San Francisco.”(我們團隊用 AI 一個下午生成了 20 個用戶畫像。聽起來很有效率對吧?結果直接掉進了 AI 人物誌陷阱—每一個都是住在舊金山的大學畢業千禧世代。)

場景二:寫 LinkedIn 貼文

“The AI persona trap occurs when teams mistake speed for rigor. AI-generated personas consistently suffer from representational bias, reflecting training data demographics rather than your actual user base.”(AI 人物誌陷阱發生在團隊把速度誤認為嚴謹的時候。AI 生成的人物誌始終存在代表性偏差,反映的是訓練數據的人口結構,而不是你真正的用戶群。)

金句

“AI doesn’t generate your users — it generates its training data’s users.”(AI 生成的不是你的用戶——是它訓練數據裡的用戶。)

參考來源

- PrivacyUX 原始文章:

- Character.AI 青少年自殺案(2024-2025,多家媒體報導)

- Harvard Business School 研究:AI companion retention strategies(2024),分析 1200 則分手對話 + 3300 人實驗

- Li et al. (2025). “Are AI-Generated Personas Trustworthy for UX and Social Simulation?” 用 6 種語言模型生成約 100 萬個 Persona

- Nielsen Norman Group: AI in UX 系列影片(2024-2025),合成用戶 vs 真實用戶對比實驗

Copyright © PrivacyUX Consulting Ltd. All rights reserved.

Joshua 是 Agentic UX(代理式使用者體驗)的先驅,在人工智能與使用者體驗設計領域擁有超過 15 年的開創性實踐。他率先提出將用戶隱私保護視為 AI 產品設計的核心理念,於 2022 年創立 Privacyux Consulting Ltd. 並擔任首席顧問,積極推動隱私導向的醫療 AI 產品革新。此前,他亦擔任社交 AI 首席策略官(2022-2024),專注於設計注重隱私的情感識別系統及用戶數據自主權管理機制。

![[回應文章] AI 生成 Persona:UX 專業人員的實用指南與警示](https://substackcdn.com/image/fetch/$s_!fFGd!,w_280,h_280,c_fill,f_auto,q_auto:good,fl_progressive:steep,g_auto/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F397f60be-87c6-4ac9-8bf4-0f55c3dd2512_1728x1296.png)