連「暴力縮放」的祖師爺 Rich Sutton 都倒戈了,LLM 的下一步是什麼?

The Bitter Lesson's Author Has a New, More Bitter Lesson for the Age of LLMs

風向的轉變:當「暴力縮放」的信徒不再相信

對,你沒看錯。那位寫下《苦澀的教訓》、被 LLM 信徒奉為「暴力縮放」祖師爺的男人,親口承認,他過去可能錯了。他最近直言,當前的 LLM 「很糟糕」,只是一群「模仿者」。

當 scaling 派的教父,其言論與最尖銳的批評者 Gary Marcus 幾乎一字不差時,你就知道,一個時代真的要結束了。

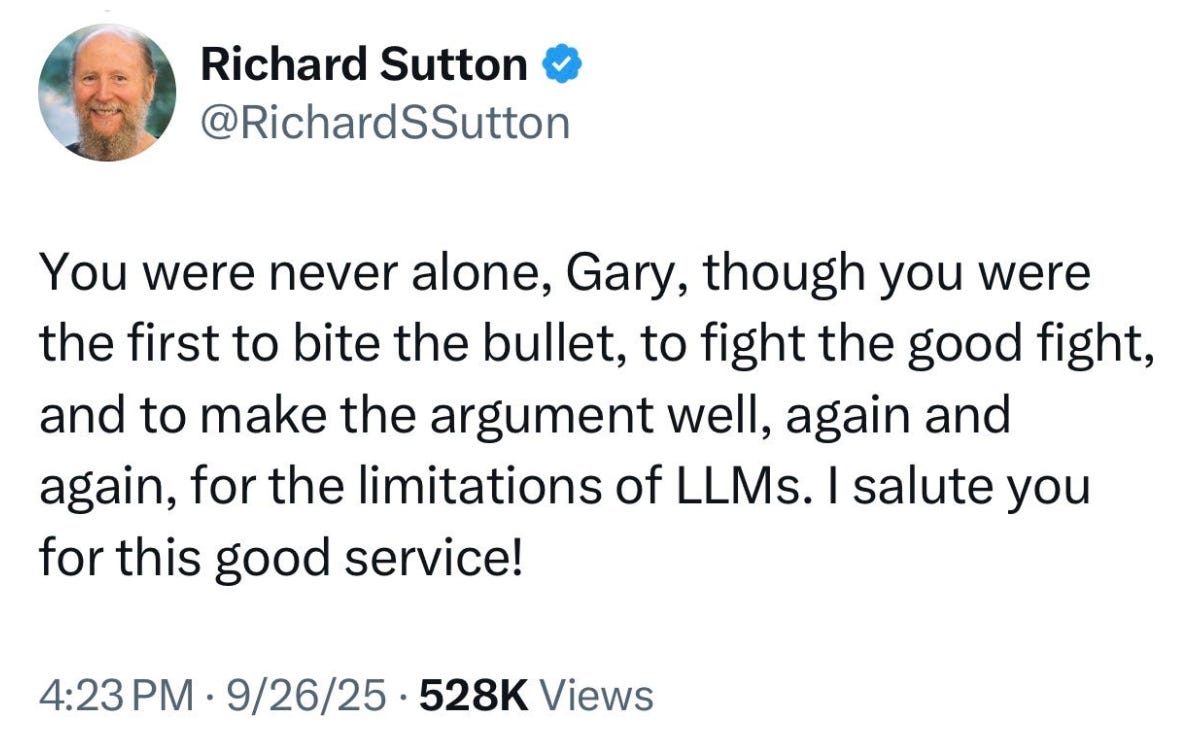

Sutton 的這番話,讓長期以來被視為「LLM 懷疑論者」的 Gary Marcus 本人也大為震驚。他在自己的部落格中寫道,Sutton 的新觀點,幾乎可以一字不差地替換成他自己的名字。他更斷言:

當 LLM 的信徒們失去了 Sutton——當 Sutton 的論調聽起來就跟我一模一樣時——遊戲就結束了。

When the LLM crowd has lost Sutton – and when Sutton sounds exactly like me – it’s game over.

Marcus 指出,不只是 Sutton,就連 Yann LeCun、Demis Hassabis 等 AI 領域的巨擘,都已陸續承認純靠暴力縮放的 LLM 路線有其極限。他認為,幾乎只剩下「騙子」(grifters) 還在假裝暴力縮放就是一切。

Sutton 的核心論點:模仿者 vs. 實踐者

那麼,Sutton 的論點究竟是什麼?

他認為,LLM 的本質是「模仿」,它們透過龐大的數據學習在特定情境下「一個正常人會說什麼」,但這並非真正的理解。相比之下,他所倡導的強化學習 (Reinforcement Learning) 則是「實踐者」,其目標是「理解世界以達成目標」。

強化學習關乎理解你的世界,而大型語言模型則關乎模仿人類... 它們不是在搞清楚該做什麼。

Reinforcement learning is about understanding your world, whereas large language models are about mimicking people... They’re not about figuring out what to do.

Sutton 犀利地指出 LLM 的幾個根本缺陷:

缺乏世界模型:LLM 只是在模仿那些擁有世界模型的人類,本身無法預測言行在物理世界會引發的後果。

模仿人們所說的話,根本不是在建立世界模型。你只是在模仿那些本身擁有世界模型的東西:也就是人類... 世界模型能讓你預測將會發生什麼。LLM 有能力預測一個人會說什麼,但它們沒有能力預測將會發生什麼。

To mimic what people say is not really to build a model of the world at all. You’re mimicking things that have a model of the world: people... A world model would enable you to predict what would happen. They have the ability to predict what a person would say. They don’t have the ability to predict what will happen.

沒有基石真相 (Ground Truth):LLM 的世界沒有客觀的「正確答案」,而 RL 中的「獎勵」(reward) 則是衡量行為好壞的唯一標準。

因為沒有對錯的定義,所以你不會得到關於何為正確言論的回饋... 沒有目標,就沒有所謂正確的言論,沒有基石真相。

You will not get feedback about what the right thing to say is, because there’s no definition of what the right thing to say is... there’s no goal... There’s no right thing to say. There’s no ground truth.

沒有真實目標:Sutton 認為,「預測下一個詞元」並不是一個有意義的目標,因為它不試圖改變或影響外部世界。智慧的本質是為了達成目標而行動。

對我來說,擁有目標是智能的本質... 「預測下一個詞元」不是一個目標,它不改變世界。詞元朝你而來,即使你預測了它們,你也無法影響它們。那不是一個關於外部世界的目標,它不是一個實質性的目標。

For me, having a goal is the essence of intelligence... “Next token prediction” is not a goal. It doesn’t change the world. Tokens come at you, and if you predict them, you don’t influence them. It’s not a goal about the external world. It’s not a substantive goal.

學習方式的侷限:他甚至斷言,生物學習的主要方式是「嘗試與犯錯」,而非模仿。監督式學習在自然界中根本不存在。

監督式學習在動物學習中並不存在... 監督式學習不是自然界中會發生的事。

supervised learning is not part of the way animals learn... Supervised learning is not something that happens in nature.

Sutton 的倒戈,代表 AI 領域幾乎所有主要思想家都已認識到 LLM 的侷限性。業界需要超越單純的擴大規模,去探索能讓 AI 具備真正理解和推理能力的全新路徑。

我的反駁:這不是取代,而是一種新的「勞動分工」

Sutton 的觀點極具說服力,但他描繪的「模仿 vs. 探索」的二元對立,或許也簡化了問題。我認為,這不是一個非此即彼的選擇題,而是一個信號,預示著人類與 AI 之間一種全新的勞動分工即將到來。

在新的分工中,LLM 將扮演「超級圖書館員」的角色——一個無與倫比的模仿與整合大師。而人類,則將退居邊緣,成為這個新生智能的「靈感來源」。