Meta Ray-Ban智慧眼鏡:做的是不要臉的活。又巧奪不要錢的個人數據用於訓練

Meta Ray-Ban Smart Glasses: Shameless Exploitation, Seamless Data Mining for AI Training

引言:瑞典調查引爆全球爭議

序言:一副 299 美元的「時尚眼鏡」,你以為在本地辨識菜單,實際上你的客廳、裸體、廁所畫面正被肯亞的審查員逐幀標註,用來訓練 Meta 的 AI。告知—同意模型在這款眼鏡上徹底瓦解。

我看完 SvD 調查,腦子裡一直轉著一句話:家長的焦慮、HCI 設計的 bug、媒體素養的缺口—這三個東西,其實是同一面鏡子的三個角度。技術決策放大了制度盲點,制度又因為資訊不對稱,被社群情緒推著跑。Meta 眼鏡不是意外,是設計選擇、法律模糊、公眾教育落差一起織出來的。你光抵制這副眼鏡?下一個 299 美元的時尚監控器還是會冒出來,只是換個鏡框而已。

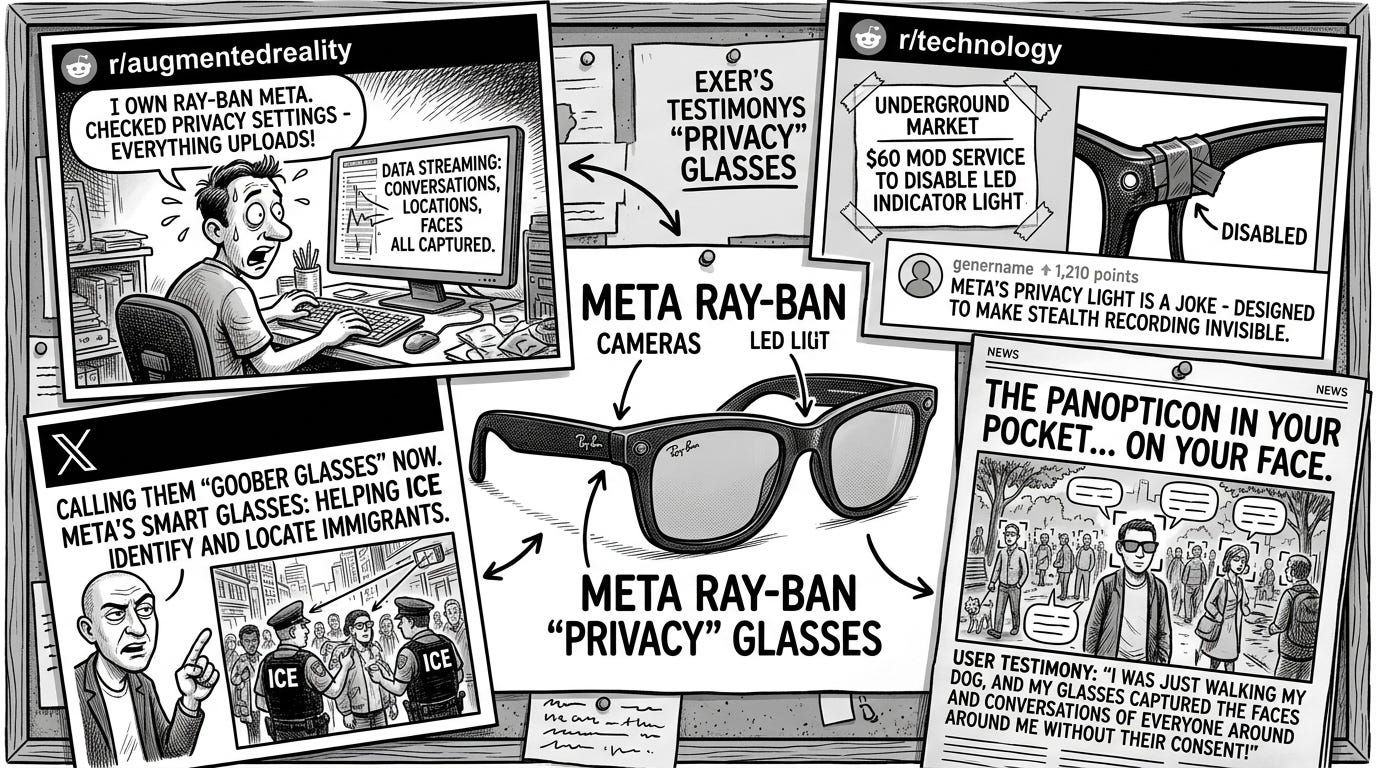

我真正第一次被「Meta 眼鏡的隱私寒毛」刺到背,不是在記者會上,也不是在論文裡,而是半夜刷 Reddit 時。在 r/technology 看到那篇討論「60 美元改裝讓 Meta 眼鏡關掉錄影燈」的貼文,底下一位用戶寫道:「我願意付錢,只求它不要再把我的資料傳給 Meta。」這句話太輕,又太重—一個明明在做「科技好事」的產品,卻在社群裡被簡化成「怎麼辦,我能買到 60 美元的『不被監控』嗎?」同一個 subreddit 裡,也有人分享「我戴上 Meta 新一代眼鏡一週,卻感覺自己像在打小報告」,底下回應如潮:「不信任 Meta」、「乾脆把鏡頭用膠布蓋住」(來源)。

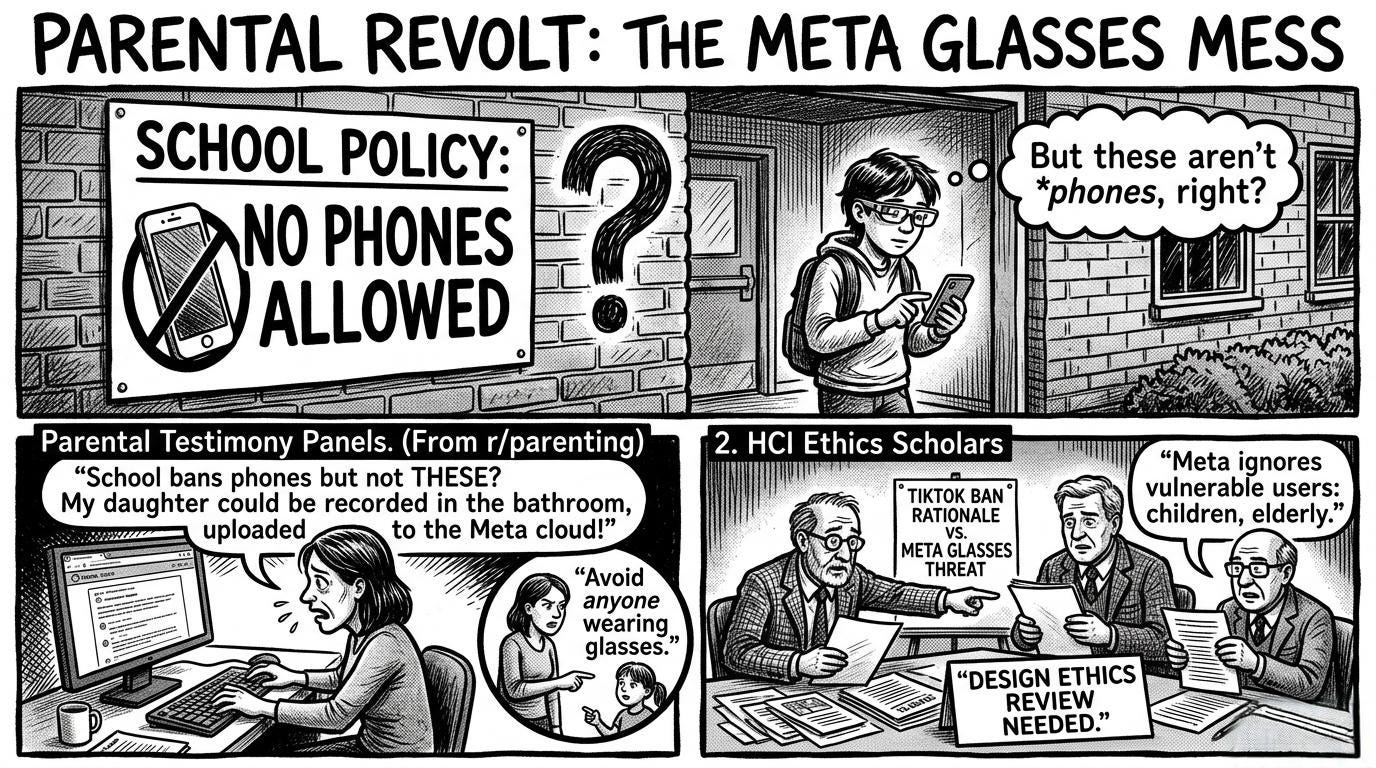

另一個擦邊的刺痛來自 r/parenting,一篇母親發文說:「我兒子班上有人戴 Meta 眼鏡,我不確定那是他錄到的畫面,還是被拍的人,但只要一想起,我就想立刻跟他去校長室談。」這不是學術研究裡的「家長焦慮」,而是真實家庭裡的半夜疑問:孩子學校禁手機,卻不禁這些「隱形鏡頭」,我們到底在幫誰保護誰?

同一時間,SvD 那篇標題「我們什麼都看得到」的調查,才剛在 Twitter 上被一位肯亞當地帳號轉發,附註:「這是我們的每天,你以為是『隱私』,對我們是工作內容。」(相關討論)那一刻,穿戴裝置的「隱私」不再是「我是否被拍」,而是「誰在看、誰在標註、誰在用」的三重結構,被這些用戶故事猛地推到你面前,彷彿自己也成了 Meta 伺服器前一盞被打亮的燈。

瑞典《每日新聞報》(SvD)與《哥德堡郵報》(GP)於 2026 年 2 月 24 日聯合發布的調查,炸開了 Meta Ray-Ban 智慧眼鏡背後的數據流真相。調查揭露,使用者啟動AI功能時,眼鏡鏡頭捕捉的影像與語音不僅傳至Meta的歐洲伺服器,還被外包給肯亞奈洛比的數千名員工審查標註,用於訓練AI模型。這些員工親口向記者坦承:「我們什麼都看得到—從客廳到裸體。」

Reddit的r/privacy 社群迅速沸騰,一位用戶怒吼:「為何我們全體默許Meta的新間諜眼鏡?」另一篇r/Cameras貼文直指佩戴者在公共場合的「變態」行為,點閱破萬。這些社群犀利評論,折射出公眾對科技巨頭的深層不信任:一副299美元的太陽眼鏡,竟化身無聲的數據吸塵器,無視佩戴者、周遭路人乃至全球審查員的隱私尊嚴。

從家長視角,這不僅是科技爭議,更是兒童安全警鐘。想像孩子在校園被同學的「時尚眼鏡」無意拍攝,畫面直飛肯亞—這是家長的噩夢。HCI倫理專家則質疑設計決策:LED指示燈雖有,但易被忽略,違背「告知即同意」的核心原則。

媒體素養專家更警告,這是資訊落差的經典案例:銷售員誤導消費者「資料全本地」,媒體放大效應卻未及時澄清。SvD/GP 調查後,瑞典公民部長 Erik Slottner 公開要求 Meta 說明,歐盟也介入質疑 GDPR 合規。以下從家長、HCI 倫理、媒體素養三重視角剖析,揭露同一結構:設計決策如何放大隱私災難。

技術內幕:無聲數據採集器

Meta Ray-Ban眼鏡的核心賣點—AI即時辨識物品、翻譯菜單或問答—依賴雲端處理。啟動「Hey Meta」後,鏡頭每秒捕捉影像,經藍牙傳至手機,再上傳瑞典呂勒奧與丹麥伺服器。這些資料隨即分配至外包商Sama的肯亞團隊,他們逐幀標註物件、臉部、動作,用以優化Llama模型。SvD調查走訪10家瑞典門市,銷售員異口同聲:「一切留在App本地,不會外傳。」事實恰恰相反:無純本地運算選項,語音預設存雲端一年,手動刪除是唯一退出途徑。

Reddit r/augmentedreality用戶分享:「我擁有Ray-Ban Meta,檢查隱私設定後嚇壞了—所有互動全上傳!」r/technology討論$60改裝關閉LED燈的黑市生意,貼文標題「Meta的隱私燈泡是笑話」,評論區一片譁然:「這是故意設計,讓偷拍變得隱形。」X平台(前Twitter)用戶嘲諷「Goober Glasses」,擔憂執法濫用:美國ICE探員已用眼鏡拍攝疑似無證移民,交叉社群媒體比對。紐約時報2月報導Meta內部「Name Tag」人臉辨識計畫,內文件直言「趁政治環境動盪上線」,Reddit r/privacy回應:「Zuck正建1984世界。」

NameTag 這功能的設計邏輯很簡單:

你戴上 Meta Ray-Ban,眼鏡鏡頭捕捉畫面,AI 瞬間辨識眼前的人臉;

然後透過 Meta 的 AI 助手,向你顯示「這個人的姓名、公開資訊、甚至與他的共通朋友」。

這功能預計最快在 2026 年底內推出,作為眼鏡系列「AI assistant」與「情境辨識」的延續。

家長角度,這技術內幕放大兒童暴露風險。孩子好奇啟動AI,眼鏡可能錄下校園霸凌、換衣間隙或家庭爭執,直送全球審查員。HCI倫理強調「預設隱私」(privacy-by-default),Meta卻反其道而行,自動遮罩常失效,導致肯亞員工看清裸體與性行為。媒體素養專家指出,這是「黑箱運作」的教材:消費者依賴行銷話術,忽略EULA細則,社群媒體放大人恐懼卻少驗證事實。

犀利社群聲音

社群媒體是隱私危機的放大鏡,Reddit與X匯聚全球憤怒。r/privacy熱帖「為何接受Meta間諜眼鏡?」獲數千贊,頂樓評論:「它不是眼鏡,是數據採礦機,訓練AI賣廣告。」r/Cameras用戶吐槽:「公共場合戴這玩意兒的人超噁心,像隱形攝像頭。」r/NoStupidQuestions貼文「Meta Ray-Bans普及,如何自保?」引發辯論,有人建議「戴墨鏡擋鏡頭」,更有人推瑞士App「Nearby Glasses」,掃描BLE訊號警報10米內眼鏡。

X上,科技意見領袖砲轟Meta:「銷售員說本地儲存,實際飛肯亞—這是系統性欺詐。」一位HCI研究者轉發SvD連結:「同意機制崩潰,非用戶被拍者零知情。」r/SeriousConversation直呼「creepy as fuck」,用戶分享哈佛生用眼鏡+AI秒查陌生人資料的Forbes報導,評論:「這是行人版Clearview AI。」肯亞本地X帳號警告女性:「俄羅斯遊客用Meta眼鏡偷拍,現在輪到全球私生活。」這些聲音不只情緒宣洩,還催生行動:r/RayBanStories呼籲集體退貨,r/pwnhub討論隱私駭客mod。

家長社群特別激憤,r/parenting分支貼文:「孩子學校禁手機,卻不禁這?」一位母親寫道:「想像女兒被同學錄下廁所,傳給Meta雲端—我已囑孩子避開戴眼鏡者。」HCI倫理派借鏡TikTok禁令,主張「設計倫理審查」,批Meta忽略弱勢用戶如兒童與老人。媒體素養專家讚社群「公民新聞」角色,但警示假新聞氾濫:「X上混雜真SvD截圖與陰謀論,公眾易陷恐慌。」這些評論如民間審判,逼 Meta 面對沉默成本。

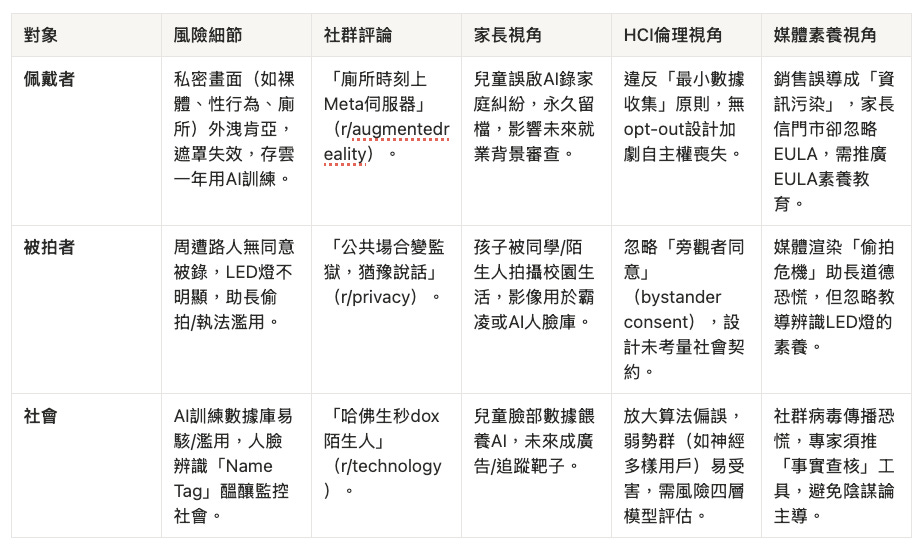

隱私三重危機

Meta眼鏡外洩風險層層疊加,形成系統性威脅。以下表格對照社群洞見與專家視角:

家長憂心兒童無知暴露: playground變戰場,眼鏡普及如「隱形手機」,呼籲校規禁令。HCI倫理借鑒Nielsen可用性原則,批眼鏡「隱形互動」誤導使用者認知,建議強制「隱私儀表板」。媒體素養強調「批判閱讀」:SvD事實基底堅實,但Reddit/X誇大需解構,教育公眾區分數據流與濫用推論。

Meta防禦與監管呼聲

Meta 回應一貫公式化:「依使用者條款與 GDPR 合規,審查位置不影響規則。」官網確實提出「為隱私設計」,並在部分情境中引入 LED 指示燈、手動控制與加密傳輸—這些措施存在,但顯然不夠好:SvD 實測顯示銷售員仍誤導消費者,瑞典 IMY 專家 Petter Flink 警告「行銷掩蓋風險」。Reddit r/privacy 反擊:「合規不等於倫理,EULA 是陷阱。」X 用戶推「#BanMetaGlasses」,呼籲歐盟 AI 法擴大穿戴管制。

監管層面有更具體的落差。歐盟 AI Act 將「遠端生物辨識」(remote biometric identification)列為高風險,要求第三方獨立評估、風險緩解計畫與公開透明度報告。Meta 的「Name Tag」人臉辨識一旦落地,將直接落入此類別;而外包商 Sama 位於肯亞,本身即構成跨境資料流與第三方處理的額外監管義務。目前並未見 Meta 主動公開此類文件,僅以「遵守條款」作為防禦—典型的「合規表象與風險實務」落差。

家長倡議加入:美國 PTA 呼籲 FTC 調查兒童數據,加拿大兒保組織援引 HCI 研究,建議「兒童隱私沙盒」。HCI 倫理派援引 EU AI Act 高風險類別,主張第三方審計;媒體素養專家推「隱私素養課程」,教家長查 App 權限、辨社群假聞。

結語:拒絕「同意幻覺」

Meta 眼鏡瓦解告知—同意模型:佩戴者被誤導,被拍者零知情,審查員心理創傷無償。Reddit 箴言:「不買不等於安全,Meta 重塑監控常態。」家長需警覺兒童環境,HCI 倫理推責任設計,媒體素養建數位韌性。三方合力,方能阻斷這「時尚監控」洪流。

現在做一件事:若你或身邊有人用 Meta AI 眼鏡,打開 Meta View → 設定 → 語音與影像 → 檢查「自動上傳」是否預設開啟、關閉「保留語音一年」;隱私設定 → 取消「與廣告夥伴共享」。若你擔心被拍,可下載 Nearby Glasses 等 App 掃描 10~15 公尺內 BLE 訊號。抵制從知情開始—下次見眼鏡,別只看款式,看隱私。

深度追問:三重視角的未竟之問

家長角度:校園裡的「隱形攝像頭」,有實證嗎?

目前沒有公開的實證案例記錄「兒童在校園被 Meta 眼鏡錄影後資料外洩」的具體傷害。但 SvD 調查已證實,Sama 肯亞員工看到的影像包括「浴室、更衣、性行為」—這些畫面來自使用者的日常生活,而非刻意錄製。

兒童的風險不在於「有人故意拍他」,而在於眼鏡佩戴者無意間捕捉的畫面會永久進入 AI 訓練集。Meta 眼鏡的邏輯:孩子的臉、聲音、校園場景,被標註後成為 Llama 模型的訓練素材,而孩子本人從未被問過「你同意嗎?」

家長該怎麼做? 建立同盟,而非防火牆:

共同辨識:跟孩子一起找一副 Meta 眼鏡的圖片,指出鏡頭位置和 LED 燈。問他:「如果有人戴這個對著你,你會注意到嗎?」這跟「共同觀看與提問」是同一個設計—不是教孩子恐懼,是教他觀察。

約定通關密語:校園版本可以是:「如果有人用眼鏡對著你拍,跟老師說,然後告訴我。」把抽象的隱私焦慮轉化為一個具體的行動觸發器。

週日偵探時間:該做法最後演化成每週日晚餐後的「偵探時間」—一起看一個影片,討論真假。家長可以把這改成「一起檢查一個 App 的隱私設定」,讓孩子從小建立「設定不是裝飾品」的認知。

關鍵是 AI 素養研究的警告:媒體素養 ≠ AI 素養。教孩子「不要被陌生人拍」是媒體素養;教孩子「你的臉被拍之後會去哪裡、被誰用、用多久」才是 AI 素養。後者才是 Meta 眼鏡時代的真正防線。

家長工具箱:三個可執行的行為建議

1 分鐘設定檢查:打開 Meta View → 設定 → 語音與影像 → 確認「自動上傳」是否預設開啟,關閉「保留語音一年」選項;在隱私設定頁檢查「第三方資料分享」,取消「與廣告夥伴共享」的勾選。

校園協議草案:建議家長或學校在行為守則中加入「穿戴裝置政策」—禁止在廁所、更衣室、走廊隱密處使用具錄影功能的穿戴裝置;要求學生在教室中將「AI 功能」與「相機錄製」分開管理,上課前暫停所有上傳選項。

近場藍牙偵測:Nearby Glasses 等 App 的原理是掃描藍牙低功耗(BLE)廣播訊號中的製造商識別碼(OUI),若 10~15 公尺內存在 Meta 或 Snapchat 智慧眼鏡會發出警示。這類工具本質上是隱私防護工具,可搭配「隱私素養課程」使用—讓孩子理解:公共場所若 App 不斷警示,代表該處可能存在被監控風險。

{合作廣告}

🧑🎓 UX 訂閱制學習計劃:把 human-in-the-loop 變成你的日常。這也是我會特別推薦 #UX訂閱制學習計劃 的原因:它不是一次性的 bootcamp,而是把借位、補位、入位拆開來,串成 3 月到 12 月的一條學習軸線。透過每月 Podcast 和專欄,先向不同領域的 UX / 產品 / AI / 服務設計講師「借位」

透過直播與 Circle 社群討論,在你的真實案子與問題上進行「補位」