[讀者回函]從被困在 chatbot 到旅遊 AI:消費金融與跨場景 Agent 的信任斷點

From Chatbot Friction to Travel AI: Trust Gaps in Consumer Finance and Cross-Scenario Agents

序言:消費金融的 Agent 化,正在把「便利」和「責任」綁在同一個對話框裡。問題不是它回得多快,而是你能不能看見它替誰說話、出錯時誰負責。

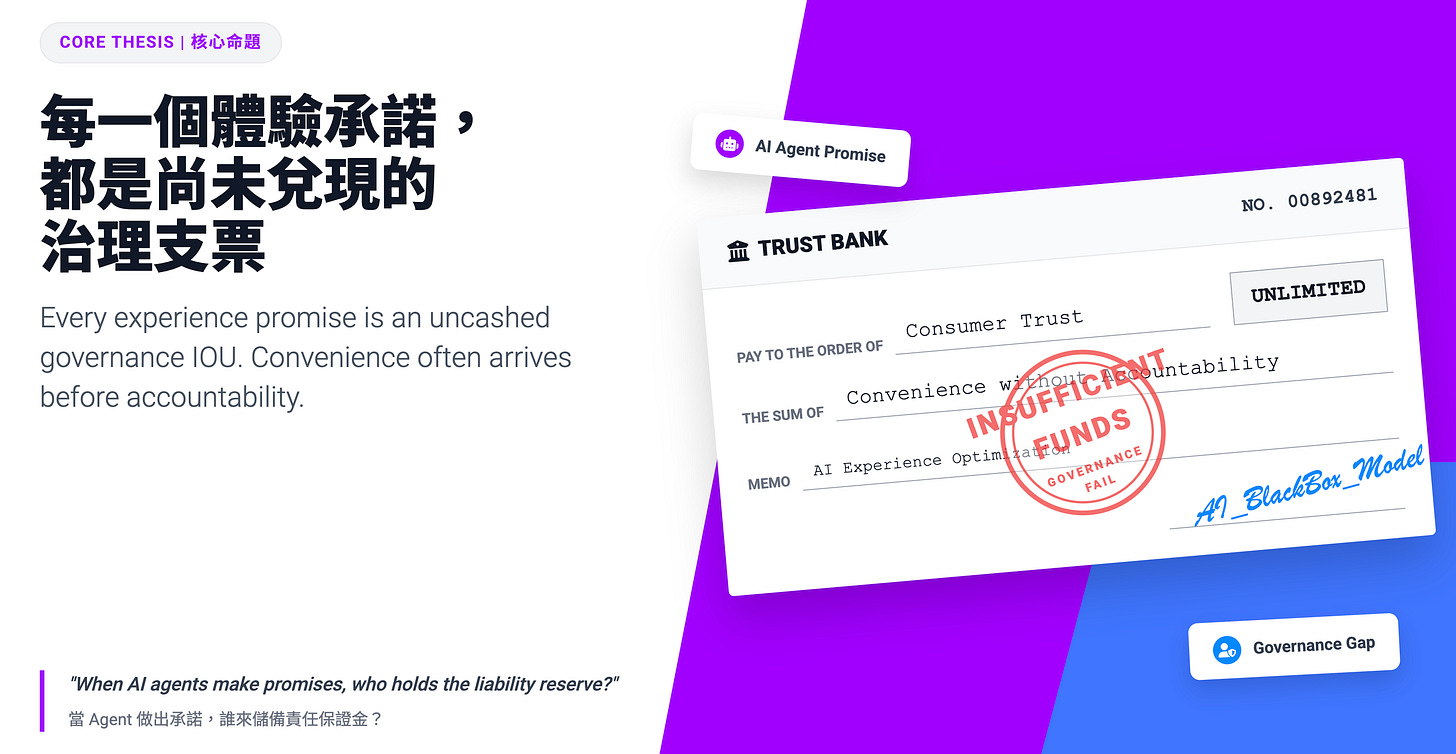

這篇的主命題很簡單:AI agent 的每一個體驗承諾,都是一張尚未兌現的治理支票。越往外看越好用,越往內看越欠帳。 在消費金融這一層,你看到的是支票開出來的表面:便利先到,責任常常還沒到。

作者補充:我最近連續看了幾批銀行客服與旅遊金融整合案例,最刺眼的不是模型能力,而是同一個介面同時扮演客服、銷售與風險篩選。你在對話框裡以為自己在問問題,系統其實也在替你做商業排序。

這個判斷有外部數據支撐。Boston Consulting Group(2025)指出,零售銀行的 AI agent 正從 FAQ bot 進化為嵌入客戶旅程的「理財教練 + 行銷入口」,但多數機構的介面與治理仍停留在前一代設計。World Economic Forum(Sims, 2024)也強調,消費者若無法辨識 AI 決策的利益歸屬與問責結構,信任會快速耗損,透明度是最低門檻,不是加分項。

前陣子我幫孩子比較加拿大幾家大行—RBC、BMO、CIBC—的學生帳戶,順便想搞清楚各家對應的學生信用卡權益和限制。這種事照理說是 chatbot 最擅長的:結構化產品比較、條件篩選、資格確認。結果每一家的 chatbot 都能回答「我們有學生帳戶」,但一問到「學生信用卡的年費減免條件是什麼」「如果同時開帳戶和信用卡有沒有綁定優惠」「畢業後自動轉成什麼方案」,就開始繞圈—要嘛丟一個 FAQ 連結,要嘛重複問我「請問您想了解哪方面的資訊」。最後我還是得打電話,而且每通電話開頭都要重新做一次身份驗證,之前跟 chatbot 講的東西完全沒帶過來。

這不是「AI 不夠聰明」的問題。這是產品決策的問題:chatbot 被設計來處理最常見的 80% 問題,但消費者真正需要幫助的,恰恰是那 20% 的比較、例外、跨產品條件。

你有沒有試過,只是想取消一張卡,卻在語音機器人選單裡繞了 20 分鐘,最後還是得重講一次身分驗證?

或者你在旅遊平台讓 AI 幫你排完一趟行程,表面上它幫你省時間,實際上你分不清它是在幫你省錢,還是在幫平台清庫存、幫銀行推高利分期?

如果金融業把 AI agent 放到第一線,問題就不再是「它聰不聰明」,而是:它到底代表誰的利益,出錯時你能不能立刻脫身。

為什麼消費者第一個感受到的,總是「被卡住」?

消費金融 Agent 的主要失敗不是「答錯」,而是「卡住」。一旦無法升級真人、無法保留上下文,信任就會在例外情境中瞬間斷裂。

從使用者回饋看,最常見的失敗不是完全不能用,而是卡在 80 分:

能回答 FAQ,但碰到費用爭議、退款跨期、授權異常就陷入循環。

這不只是體感。Commonwealth Wealth Building Initiative 與 boost.ai(2024)的實地研究顯示,消費者對 chatbot 處理例行任務的信任相對高,但一旦進入個人化建議、貸款申請或金融教育,接近 80% 受訪者仍偏好真人;研究把這個落差稱為「trust threshold」。換句話說,介面流暢不等於信任可延伸。

HCI 研究也有同樣結論。Gnewuch 等人(2023)在真實互動觀察中指出,使用者遇到邊界案例時會反覆重述、測試、校正,試圖讓系統理解語境;這種額外認知負荷本身就是 UX 失敗,因為它把本該由系統承擔的語境判讀責任,轉嫁給使用者。

這種失敗比「明顯錯誤」更傷信任,因為介面看起來流暢,實際卻不可救援。

使用者真正要的不是「像人」,而是三個最低保障:

我現在到底在跟誰互動(客服助理、銷售代理、推薦引擎)?

我能不能一鍵升級真人,而且不用重講一次?

這個建議是替我最佳化,還是替平台最佳化?

只要這三題答不清楚,再多個性化都只是包裝。

這類抱怨在社群裡非常一致。r/PersonalFinanceCanada(2024)就有用戶描述近似情境:RBC 丟連結、CIBC 反問需求、BMO 重複同一句話,而問題其實只是「學生帳戶什麼時候會轉成人方案」。

為什麼跨場景 Agent 會把便利變成責任混線?

當金融決策跨銀行、旅遊、零售與支付平台時,介面雖然單一,責任實體卻是多方拼接。這會把「建議」和「引導」混在一起。

消費金融早就不只發生在銀行 App。

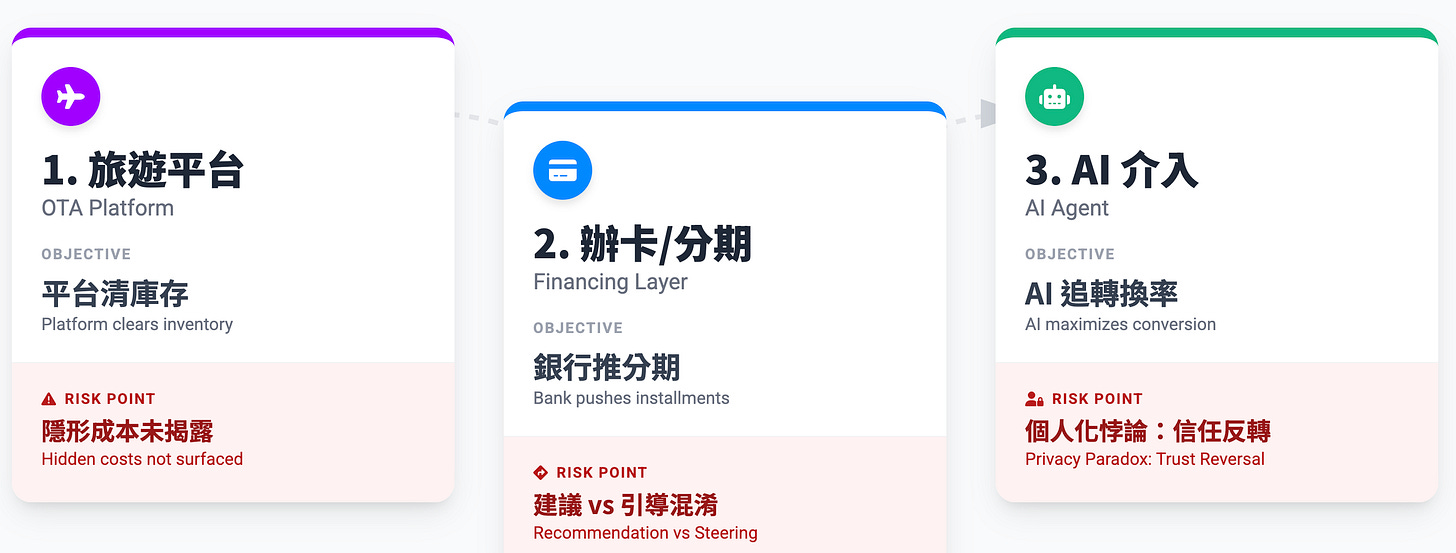

你在旅遊平台分期、在電商延後付款、在通訊軟體點擊「立即辦卡」,同一段旅程其實跨了多個機構。

舉一個越來越常見的場景:你在旅遊平台讓 AI 幫你排行程,它推薦了一個機加酒方案並建議用某張信用卡分期。你點了確認。三個月後帳單出現一筆你不認識的手續費,你去找旅遊平台,平台說「分期是銀行的事」;你去找銀行,銀行說「方案是平台推薦的」;你回頭找那個 AI 助手,它已經不記得那段對話了。

這段旅程裡,前台是一個 Agent,後台是三套商業目標:平台要清庫存、銀行要推分期、AI 要最大化轉換率。

當系統告訴你「這樣最划算」,你很難知道它根據的是風險模型、佣金模型,還是真正的用戶價值模型。

這裡可以用一個研究框架看得更清楚:所謂 personalization-privacy paradox。ACR Journal(2025)的彙整研究指出,個人化推薦對信任通常有顯著正效應(報告整理值約 β = 0.52),但在高隱私敏感使用者身上,這個效應會大幅縮水,甚至反轉成懷疑;一旦使用者感知系統在替第三方利益優化,信任會直接掉頭。

我自己就踩過這種坑。帶家人訂旅遊行程時,AI 幫我從可用日期裡挑了一個「最佳方案」。看起來價格合理,但它沒告訴我那個日期是旺季邊緣、房型不含早餐。家庭房本來就要提早訂,等我發現時已經沒有含早餐的選項了。五口人、不足額早餐券、現場加購早餐的價格是預訂的兩倍—這些隱形成本在 AI 的「最佳推薦」裡完全不存在。它優化的是房價,不是你的總支出。淡季旺季的價差、有無早餐的陷阱、家庭房的提前預訂窗口,這些對家庭旅遊來說才是真正的決策變數,但 AI 的推薦模型裡根本沒有這一層。

這就是新的治理缺口:責任外觀單一,責任實體分散。

沒有揭露機制,使用者就在「被建議」和「被引導」之間失去判斷力。

WEF(Sims, 2024)也點出同一問題:當 agent 橫跨銀行、平台、旅遊服務等多方提供者時,「誰對決策負責」會變成治理最難題之一。McKinsey 與 Skift(2025)在旅遊場景的分析更直接:使用者通常無法判斷系統優化目標到底是總成本最小,還是供應商佣金最大。

法律已經給訊號了:chatbot 說錯話,企業不能切割

Air Canada chatbot 責任案已把底線講清楚:對消費者來說,對話視窗就是公司。企業不能主張「那是機器自己說的」來卸責。

案情很簡單:旅客依照 Air Canada 官網 chatbot 的折扣資訊購票,事後航空公司說「bot 說錯了不算」,但法院判定公司仍需承擔該資訊帶來的承諾責任。

Air Canada 案的關鍵,不是模型幻覺本身,而是責任歸屬。

Jake Moffatt 只是一名為了幾百塊加幣差價(約 800 多加幣)據理力爭的普通乘客,但他卻無意間促成了全球第一個明確界定「企業不能把 AI 當作免責擋箭牌」的法律實務判例。這也正是為何這個案件在 2024 年會震動整個企業 AI 導入圈。

企業若把 Agent 放在第一線,就必須承擔第一線承諾。

把法律落回 UX 設計,中間還有一道關鍵橋樑:handoff quality。EDPS(2025)在 human oversight 技術簡報裡指出,自動化系統的交接場景常常削弱而非強化人類判斷;如果真人接手時看不到 AI 的前序決策脈絡,人類監督就會變成形式合規。

我會把這件事翻成產品語言:

你不是在設計「回覆品質」,你在設計「責任介面」。

CFA Institute(Wilson, 2025)在金融場景研究也支持這點:explainability 不只是監管需求,而是實務上的問責工具。沒有可追溯解釋就上線,等同把解釋責任外包給事後客訴流程。

銀行案例也在往同一方向走。DBS 公開談到,他們雖然已把 AI 大規模導入,但在高風險決策仍保留人類覆核,不直接把生成式回覆無條件釋出到客戶端(IBF Singapore, 2025)。

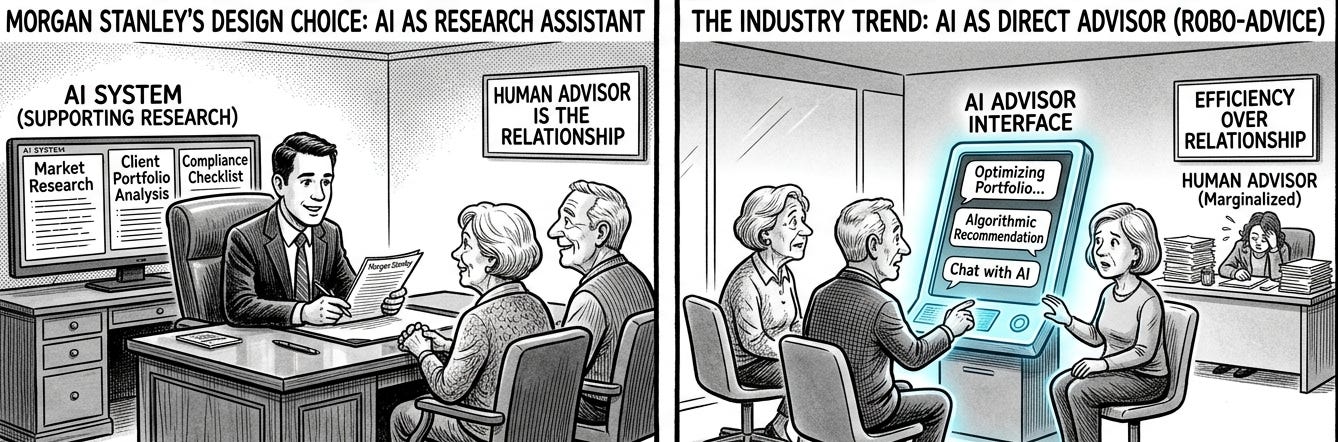

Morgan Stanley 的作法更明確:他們的 AI @ Morgan Stanley Assistant 從一開始就定位為「理專的研究助手」,不是「客戶的對話窗口」。系統可以幫理專快速調出市場研究、客戶持倉分析、合規檢查清單,但所有面客溝通仍由理專發出,AI 不直接接管受託關係。這個設計選擇的背後邏輯是:在高信任場景,AI 的角色是降低理專的認知負荷,不是取代理專的判斷責任(UX Magazine, 2024)。

先補一個背景:Piyush Gupta 是 DBS 長期 CEO,DBS 近年在亞洲銀行裡屬於最早把 AI 從單點工具推到全行營運流程的機構之一;所以他談的不是概念預測,而是已經在大規模真實場景運行後的治理取捨。

這裡有兩句業界原聲可回放(時間碼為近似位置):

Piyush Gupta 談到對客端上線節奏:「We will always have a human in the middle.」(約 24:00)

他同場也說:「within the next 12 to 24 months we’ll be in a position to go direct to customer」(約 25:10)。

這兩句放在一起,就是金融 Agent 治理最真實的矛盾:要快,但不能失控;要放量,但不能無責任鏈。

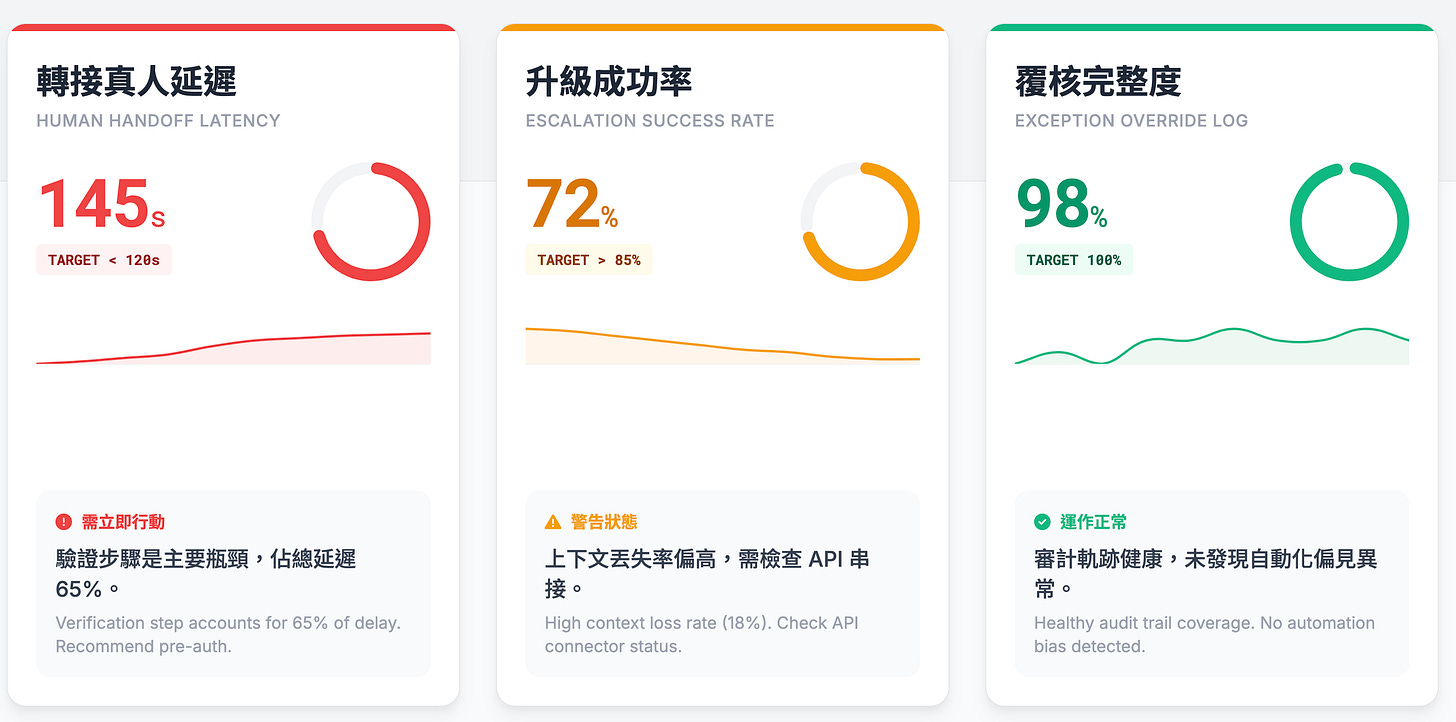

你現在就能檢查的三個指標是什麼?

先別談宏大框架,先看三個可觀察指標:真人接手延遲、升級成功率、例外覆寫紀錄。這三個數字決定你是在做體驗,還是在做風險外包。

{合作廣告}

🧑🎓 UX 訂閱制學習計劃:把 human-in-the-loop 變成你的日常。這也是我會特別推薦 #UX訂閱制學習計劃 的原因:它不是一次性的 bootcamp,而是把借位、補位、入位拆開來,串成 3 月到 12 月的一條學習軸線。透過每月 Podcast 和專欄,先向不同領域的 UX / 產品 / AI / 服務設計講師「借位」

透過直播與 Circle 社群討論,在你的真實案子與問題上進行「補位」