[讀者回函]AI 共同理專與數位 RM:私人銀行與商業銀行的高風險 Agent 治理

AI Co-Advisors and Digital RMs: Governing High-Risk Agents in Private and Commercial Banking

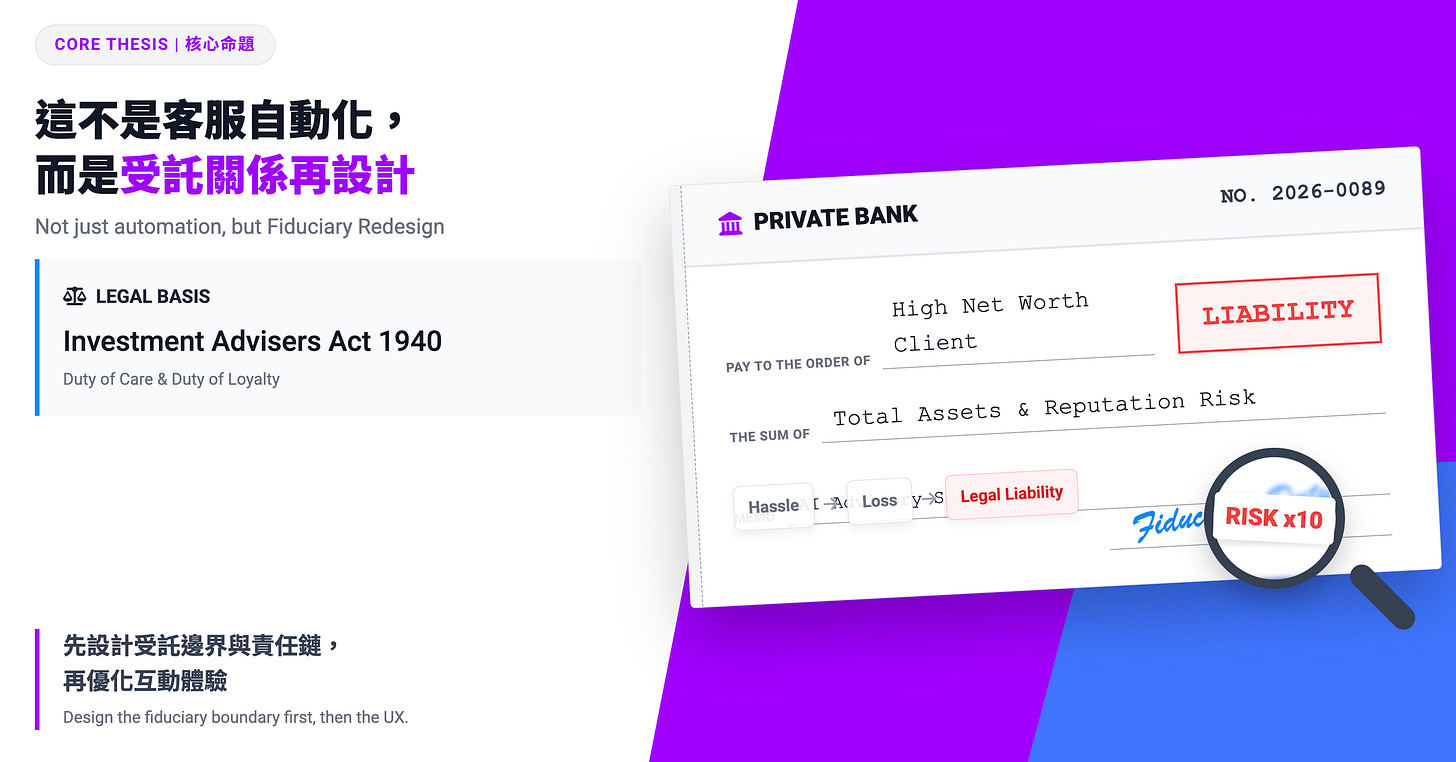

序言:消費金融那一篇已經把問題講清楚:chatbot 的失敗不是技術問題,而是設計決策—誰的利益被優化、誰能喊停。這一篇把同樣問題搬進私人銀行與企業金融:問題沒變,但每個答案的重量都放大了十倍。

作者補充:如果說消費金融是治理支票的表面,私銀與商銀就是同一張支票的面額。AI 不再只是推薦哪張卡、哪個分期,而是介入家族資產配置、企業授信判斷、流動性安排。兌現失敗的後果也從「麻煩」變成「損失」甚至「法律責任」。

先交代名詞:這裡的 RM 是 Relationship Manager(客戶關係經理),在私銀/商銀場景通常是把產品、風險、合規和客戶需求串在一起的第一責任節點。

所以當我們說「數位 RM」,不是多一個聊天介面,而是把責任節點數位化。

我自己最近就碰到一個案例。一家私人銀行急著為高淨值客戶打造加密貨幣的 AI Agent 服務—概念類似 OpenClaw,讓 Agent 幫客戶做資產配置建議、即時回應市場波動、協助短期變現。

我第一個擔心的不是服務品質,而是受託邊界。客戶在一般金融資產配置(股票、債券、基金)和加密貨幣短期變現之間切換時,Agent 沒有辦法謹守界線。它不知道「這個建議屬於受監管的投資顧問行為」還是「這只是加密貨幣的資訊提供」—但對客戶來說,這兩者來自同一個對話框,看起來是同一個「理專」在說話。

更危險的是慣性授權:用戶一開始只授權查詢,後來授權模擬,再後來授權執行。每一步都是小幅放權,但累積起來 Agent 已經能動客戶的真金白銀,而沒有任何機制提醒「你剛剛授權的這個動作,風險等級已經跳了兩級」。

這不是單一團隊的錯覺。The Hacker News(2026)援引企業 AI 安全研究,把這種現象稱為 agentic authorization bypass:agent 在跨系統運作時,實際權限可能超過任何單一使用者原始權限,且關鍵操作被歸因在 agent 身份下,形成「authorized yet invisible」的監控盲區。

這個案例讓我確認一件事:在私銀場景,AI Agent 的問題不是「能不能做」,而是「受託關係的邊界有沒有被設計進去」。如果沒有,速度只會放大風險。

而這條邊界本質上是法律邊界。根據《Investment Advisers Act of 1940》,投資顧問對客戶負有 duty of care 與 duty of loyalty。JD Supra(2025)對投資管理 AI 的分析很直接:AI 不會取代受託義務,只會放大其複雜性;同一對話流程若混合受監管建議與非監管資訊,機構不能靠「僅供參考」標籤切割責任。

為什麼這不是客服自動化,而是受託關係再設計?

私銀/商銀的關係本質是長期顧問制—客戶買的不是一次回答,而是持續的判斷品質與風險把關。AI 進入這種關係,最常見的三個誤判都跟「偷換責任」有關。

私人銀行與商業銀行的關係本質上接近長期顧問制。客戶買的不是「一次回答」,而是持續的判斷品質、脈絡記憶與風險把關。

當 AI agent 進入這種關係,有三個常見誤判:

把「生成能力」誤當成「受託能力」。 AI 可以快速產出一份資產配置建議書,但「產出」不等於「負責」。受託能力的前提是:出錯時有人承擔後果。 Columbia Law Review(2017)在 robo-advisor 脈絡早就指出,監管焦點不該只問系統能不能做,而要問系統是否把利益衝突揭露清楚;生成式 AI 只讓這個衝突更不透明。

把「回覆一致」誤當成「判斷可靠」。 模型每次給出一致的答案,不代表那個答案適合這位客戶的當下情境。一致性是技術特性,不是信任基礎。 高風險 XAI 研究(Yousif et al., 2026)也強調 consistency 和 reliability 是兩個維度。答案穩定不代表判斷正確,這種誤判可視為 consistency illusion。

把「流程加速」誤當成「責任可移轉」。 授信審批從三天變三小時,但如果簽核節點被跳過,速度只是把風險壓縮到更短的反應窗口裡。 TRM Labs(2026)在自主 agent 與金融犯罪風險報告裡指出,當 agent 持有交易簽核能力,prompt injection 或憑證洩漏會直接觸發未授權資金流動;監管事後第一個追問通常就是 escalation 機制是否真的存在且被觸發。

AI 可以提案、比對、提醒,不能默默吞掉人類應負責的決策節點。

數位 RM 的價值是什麼?不是全自動,而是可追責的人機分工

領先銀行的做法不是讓 Agent 取代理專/RM,而是「高頻分析 + 低頻定奪」—AI 做資料整合與情境模擬,關鍵節點由人類簽核,全程留痕。

近年案例顯示,走得比較前面的銀行都選了同一個架構:

前段由 AI 做資料整合、情境模擬、文件摘要。

關鍵節點(投資建議採納、授信條件承諾、風險例外核准)由人類明確簽核。

整個過程留下可追溯記錄,便於內控、合規與事後爭議處理。

CFA Institute(Wilson, 2025)對這種分工的表述很清楚:AI 是判斷輔助,不是判斷替代;受影響決策的最終責任仍在持牌顧問與機構。

具體來說:TD Wealth 在 2025 年推出的虛擬助手,定位就是「強化理專與客戶的互動品質」,不是取代理專。系統幫理專預先整理客戶持倉、近期市場事件與合規提醒,但投資建議的最終發出仍由理專負責(TD Bank Group, 2025)。

DBS 在企業金融端也是類似思路—2025 年把 Gen AI chatbot 推給所有企業客戶,但明確限定在「資訊查詢與文件摘要」,授信決策與風險例外仍走人工簽核流程(DBS Bank, 2025)。Morgan Stanley 也採同路徑:AI @ Morgan Stanley Assistant 聚焦在研究輔助與知識擷取,面客建議仍由理專與團隊承擔(Celent, 2024)。

這個結構的好處是:效率被放大,但責任沒有蒸發。反過來說,如果你看不到清楚簽核節點,多半代表風險只是被藏起來。

{合作廣告}

🧑🎓 UX 訂閱制學習計劃:把 human-in-the-loop 變成你的日常。這也是我會特別推薦 #UX訂閱制學習計劃 的原因:它不是一次性的 bootcamp,而是把借位、補位、入位拆開來,串成 3 月到 12 月的一條學習軸線。透過每月 Podcast 和專欄,先向不同領域的 UX / 產品 / AI / 服務設計講師「借位」

透過直播與 Circle 社群討論,在你的真實案子與問題上進行「補位」