[讀者回函]AI 的「永久記憶」悖論:當 OpenAI 記住你的病歷與職涯,亞洲的法律能保護你嗎?

The Paradox of Permanent Memory: How OpenAI's Acquisitions Rewrite Fairness in Healthcare and Careers

序言

當 OpenAI 在 2026 年 1 月接連宣佈收購 Torch(醫療記憶整合)與 Convogo(領導力評估自動化)時,我的社群動態牆上一片叫好。「終於,醫療資料不再是孤島了!」「HR 的繁瑣工作終於要被解放了!」

我擔心的不是 AI 會不會搶走工作,而是我們正在興高采烈地建造一座「無法遺忘」的監獄。這兩筆收購案,標誌著 AI 從「處理資訊」正式跨入「管理記憶」的時代。當系統開始記住你的血糖波動、你的職場評價,並將這些記憶跨平台、跨時間地串聯起來時,我們面對的不再是聰明的工具,而是一個永遠記得你所有弱點、且可能帶有偏見的判斷者。

這篇文章不是要談商業策略,而是要談談身為普通人的我們,在這個「永久記憶」的時代,還剩下多少轉身的空間。

核心命題:Torch 與 Convogo 如何將「一次性評分」變成「永久檔案」?

當醫療與職涯被交給「會記憶」的 AI 系統,公平的風險不在模型多聰明,而在記憶如何被保存、被搬運、被重複使用。Torch 讓健康資料跨系統匯流,Convogo 讓評估記錄跨年份累積;兩者都把「一次評分」變成「長期檔案」。問題是:你能不能看見、質疑、修正這份檔案?

你可能會問:「這不就是數位化嗎?有什麼好大驚小怪的?」

差別在於「不可逆性」。過去,你的病歷分散在三家診所,你的績效評估留在前公司的硬碟裡。這些資訊是破碎的、會被遺忘的。但 Torch 和 Convogo 的目標,是建立一個統一的、連續的記憶層。

這意味著什麼?意味著你在 A 公司的「溝通不良」評價,可能會被 AI 記住,並隱性地影響你申請 B 公司時的適配度評分。意味著你在 30 歲時的一次憂鬱症就醫紀錄,可能會在 50 歲時被保險 AI 重新挖掘出來,作為拒保的依據。

這不是科幻小說,這是正在發生的基礎建設。

便利的代價:我們為「地板革命」拍手叫好?

因為便利是最好的麻醉劑。醫生省下 10 分鐘問診時間,HR 省下 20 小時報告撰寫。我們為了這些「地板級」的效率提升,欣然交出了數據的控制權,卻忘了問:這些數據最後去了哪裡?

讓我們誠實一點,Torch 的承諾真的很誘人。

想像一下,你是一位 72 歲的糖尿病患者。以前,你得抱著一疊厚厚的檢驗報告,在不同科別的醫生之間奔波,每次都要重新解釋一遍病情。現在,Torch 把這些孤島全部打通,ChatGPT Health 直接告訴你:「根據過去半年的跨診所紀錄,你的低血糖頻率增加了 30%。」

這聽起來像魔法,對吧?Open Evidence 的成功也證明了,醫生們愛死這種能省時間的工具了。

同樣的,Convogo 對企業來說也是神蹟。月薪 15 萬的顧問不用再花幾十個小時寫 360 度評估報告,AI 自動幫你搞定。OpenAI 用 “acqui-hire” 把 Convogo 團隊買下來,就是要把這種「自動化魔法」變成標配。

但這就是陷阱所在。我們看見了「效率」,卻忽略了「代價」。當我們為了省事而依賴 AI 幫我們「記住」和「判斷」時,我們實際上是在把對自己身體和職涯的詮釋權,讓渡給了演算法。

反方視角:業者眼中的「效率與安全平衡」

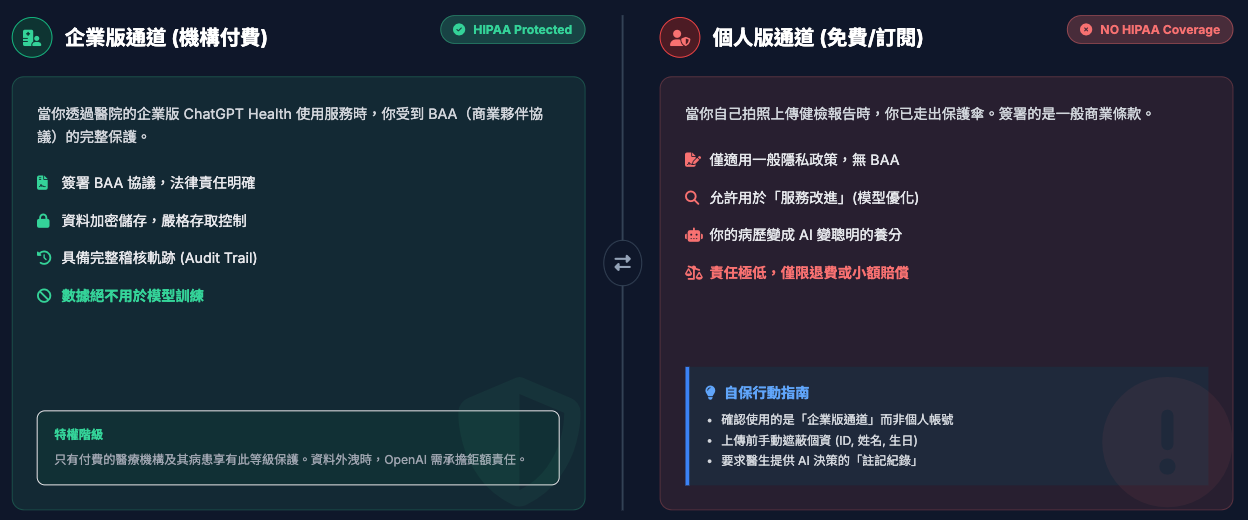

業者主張「分級保護」與「效率紅利」是最佳解方。OpenAI 強調企業版 BAA 已覆蓋 95% 醫療需求,消費者版亦提供「不訓模」選項;Convogo 則舉證日本試點滿意度提升 15%。然而,這並未解決「資源階級」帶來的保護落差問題。

當然,站在業者的立場,他們會提出不同的觀點。

OpenAI 強調,企業版 BAA 已經覆蓋了 95% 的醫療機構需求,而消費者版也提供了「不訓練模型」的選項(OpenAI, 2026a, 2026b)。他們認為,問題不在於「有沒有保護」,而在於「用戶是否選擇了正確的版本」。

Convogo 的日本試點也顯示了積極的結果:員工滿意度提升 15%,HR 效率顯著提升(Convogo, 2025)。這證明了,當 AI 評估系統運作良好時,確實能帶來實質的效益。

但這些回應,恰恰凸顯了我們之前提到的「階級問題」:有資源選擇企業版的機構,享有完整的保護;沒有資源的個人用戶,只能選擇「不訓練模型」的選項,但這並不代表他們的資料不會被用於其他用途(如服務改進、第三方處理)。

問題不在於「業者有沒有提供選項」,而在於「這些選項是否真的保護了用戶的權利」。當你選擇「不訓練模型」時,你放棄的是什麼?你獲得的又是什麼?這些問題,業者的回應並沒有完全解答。

醫療記憶:HIPAA 保護不了的「階級斷層」

企業版安全,個人版裸奔。這是最大的謊言。當你用個人帳號上傳病歷換取建議時,你已經走出了 HIPAA 的保護傘。OpenAI 的 BAA 只保護付錢的機構,不保護想省錢的你。

這裡有一個大多數人(甚至很多醫生)都搞錯的觀念:你以為用了「醫療 AI」,你就受到 HIPAA(健康保險流通與責任法案)的保護。

錯。大錯特錯。

如果你是透過醫院的企業版 ChatGPT Health 使用服務,沒錯,你有 BAA(商業夥伴協議)罩著,資料加密、審計、洩漏通報一樣不少。

但如果你是自己把健檢報告拍照上傳到個人的 ChatGPT 帳號呢?抱歉,那一刻起,你就不在 HIPAA 的保護範圍內了。你簽的是一般商業隱私條款。EPIC(電子隱私資訊中心)在 2026 年 1 月的公開信裡講得很直白:消費者版的條款,往往允許資料被用於「服務改進」(EPIC, 2026, January)(https://epic.org/document/openai-chatgpt-health-privacy-concerns/)。

翻譯成白話文就是:你的病歷,變成了訓練 AI 變得更聰明的養分。而且,一旦發生資料外洩,OpenAI 對你的責任,跟對企業客戶的責任是完全不同等級的。

這就是「階級」。有錢付企業版的機構享有隱私,沒錢只能用個人版的散戶貢獻數據。

職涯記憶:當演算法偏見成為「永存詛咒」

偏見一旦被寫入記憶,就成了真理。傳統面試的偏見會隨時間淡去,但 AI 的記憶是累積的。一次錯誤的「缺乏領導力」標籤,可能會在未來的每一次評估中被召喚出來,成為你永遠無法擺脫的幽靈。

Keep reading with a 7-day free trial

Subscribe to AI 素養與隱私體驗 to keep reading this post and get 7 days of free access to the full post archives.