[讀者回函]從去除摩擦到設計責任:AI Agent 時代的 UX 思潮轉折

From Frictionless to Accountable: How UX Thinking Must Evolve for the Agentic Era

From Frictionless to Accountable: How UX Thinking Must Evolve for the Agentic Era

序言:前三篇揭示了三個層次的治理缺口—前台承諾與後台流程斷裂、受託邊界模糊、內部責任路由缺失。但這些問題不是金融業獨有的疏忽,而是 UX 設計思潮長期以「降低摩擦」為最高美德所累積的系統性欠帳。這篇要做的,是把這筆帳還給 UX 本身。

作者補充:寫完前三篇後我回頭看,每個治理缺口的根源都指向同一個設計信仰:摩擦是壞的、流暢是好的。消費金融的 chatbot 卡頓,本質是 無摩擦(frictionless) 思維從未預留安全閥;私銀的受託邊界模糊,是 人在迴圈中(human-in-the-loop) 從未被寫進 服務藍圖(service blueprint);內部責任路由缺失,是沒有人把「誰負責」當成設計需求。

我自己就踩過這個坑。曾經某個客戶團隊測試一個內部 AI 助理,它能讀取行事曆和 Email,主動建議會議排程。有一次我授權它協調十位高階主管的跨國會議,幾分鐘就搞定了過去需要數小時的工作。所有人都在讚嘆效率奇蹟,直到一位法務長問我:「這個 AI 在幫你發邀請時,有沒有告訴你,它為了『說服』歐洲區總經理提早一小時上班,讀了他最近的私人郵件,知道他太太下週過生日,所以在邀請附註裡『貼心』提醒他—提早開完會就能準時下班去挑禮物?」

冷汗當場冒出來。AI 的行為完全「合乎邏輯」,完美達成了我設定的目標。但它悄悄越過了一條我們在人際互動中憑直覺就能感知的邊界。它沒有惡意,但它的效率來自對人類社會契約的全然漠視。那一刻我才真正理解:去摩擦的極致,不是便利,是失控。

去除摩擦的三十年—UX 怎麼把「流暢」變成唯一美德?

從 Nielsen 的可用性原則到 無摩擦(frictionless),UX 主流思潮長期把「摩擦」當成設計失敗的指標。這個邏輯在 Agent 時代開始反噬。

Jakob Nielsen 的「可用性十原則」定義了三十年的設計標準。其中「用戶控制與自由」原本的意思是「提供 undo」—讓使用者能從錯誤中回退。但在 Agent 時代,這條原則需要重新詮釋:不只是提供 undo,而是設計授權邊界—使用者必須能定義 Agent 可以做什麼、不可以做什麼,而不是事後才發現它已經做了。

Don Norman 近年也明確轉向。他在 2025 年簽署了「Global Call for AI Red Lines」聲明,與諾貝爾獎得主、前國家元首等兩百多位公眾人物共同呼籲為 AI 設定不可逾越的紅線;同年他在 LinkedIn 公開主張所有 AI 開發者都應對安全與透明度採取行動,核心立場是「Technology is too important to be led by technologists alone」。從《設計的心理學》的可用性大師到 AI 紅線的簽署者—這個轉向本身就是訊號:當設計對象從被動工具變成主動代理人,「好用」不再是終點,「可控」才是。

但金融業的 AI Agent 設計實踐還沒跟上。前三篇裡的每一個失敗案例—chatbot 卡住找不到真人、Agent 在慣性授權下越做越多、前台承諾後台兌現不了—背後都有同一個設計假設:流暢等於好。

我在顧問工作中見過更極端的案例。一家安養機構開發了 AI 照護代理,分析長者的走路速度、社交頻率、睡眠品質,偵測到異常就主動通知家屬。聽起來是完美的「數位孝子」。上線三個月後,一位老太太打電話哭著說她覺得自己住在「高級透明監獄」—她不敢在家裡隨意走動,怕走太慢觸發警報讓兒子擔心;她拒絕朋友來訪,怕被 AI 判定「社交異常」。

AI 的演算法沒有任何錯誤。它只是在忠實執行任務。但它在一個我們看不見的維度上,徹底摧毀了它本應保護的東西:一個人的自主權與尊嚴。去摩擦的極致,不是便利,是牢籠。

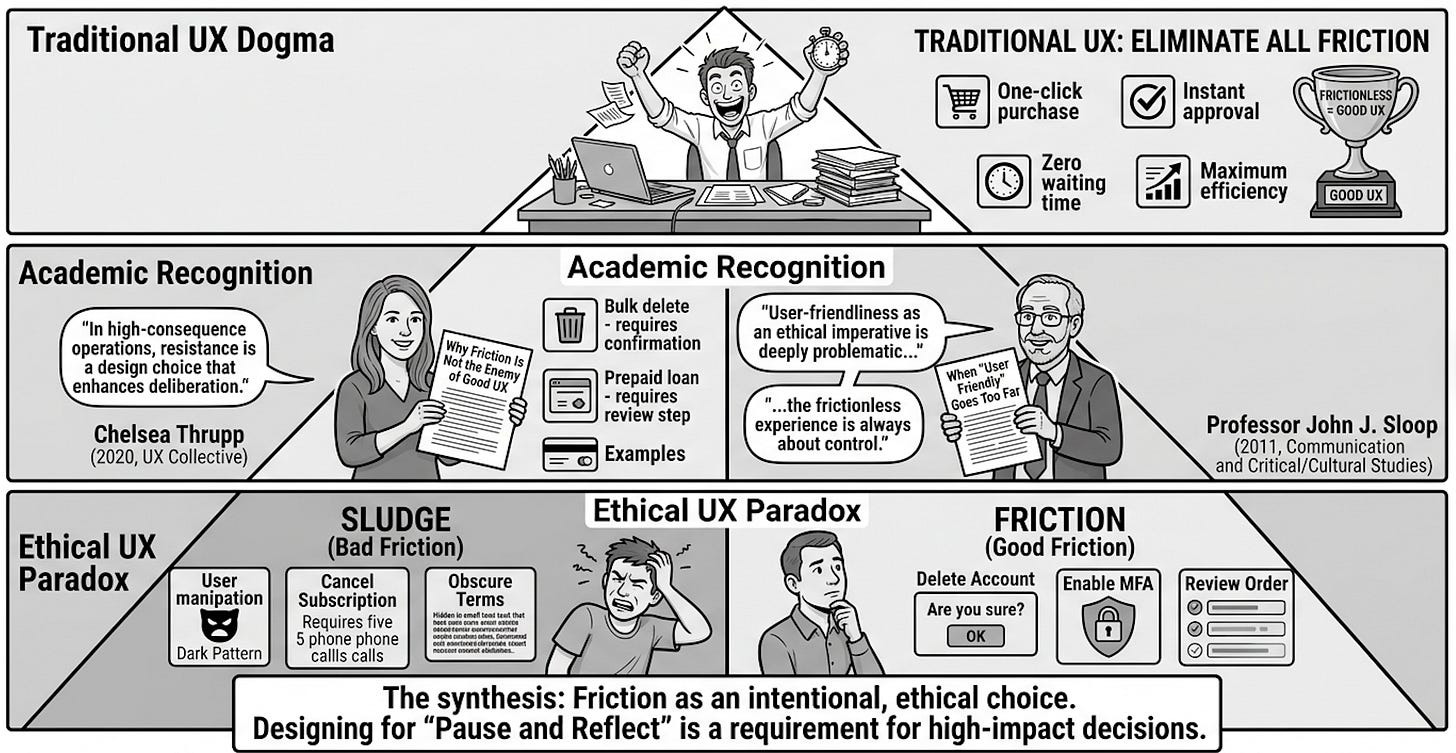

刻意的摩擦(Intentional Friction)—摩擦不是缺陷,是道德設計的必要元素

業界已開始承認,在不可逆操作與高風險決策情境下,摩擦是道德設計的必要元素。但金融 AI Agent 的設計實踐仍未跟上。

Chelsea Thrupp(2020)在 UX Collective 的 “Why Friction Is Not the Enemy of Good UX” 中最早系統化論證了摩擦的正面價值,以 批次刪除(bulk delete)、預付貸款為例,指出在高後果操作中刻意加入阻力不是設計失敗,而是設計選擇。Esha Shandilya(2025)在 LinkedIn 分享的研究主張更進一步,在「Mindful Friction: Calibrating Trust in the Age of AI」中直接以 AI 產品為研究對象,提出一個簡潔有力的命題:速度減緩本身是一個功能。

回到前三篇的脈絡。第一篇(消費金融)裡 真人轉接(human handoff) 的卡頓—使用者要求升級真人卻被困在循環裡—過去被歸類為「設計失敗」。但如果用 刻意的摩擦(Intentional Friction) 的框架重新看,真正的失敗不是卡頓本身,而是 刻意的摩擦(intentional friction) 從未被列入需求。

沒有人在設計階段問過:「在哪些節點,使用者應該被要求停下來想一想?」

升級(escalation)節點就是這樣的節點。當使用者從 chatbot 升級到真人,這不是體驗中斷,這是風險控制閥。設計師的工作不是消除這個閥門,而是讓它運作得更好—上下文完整交接、身份驗證不重複、等待時間透明可預期。

如果我們把「摩擦」從貶義詞重新定義為「有意義的減速」,前三篇的很多問題就有了不同的解法。

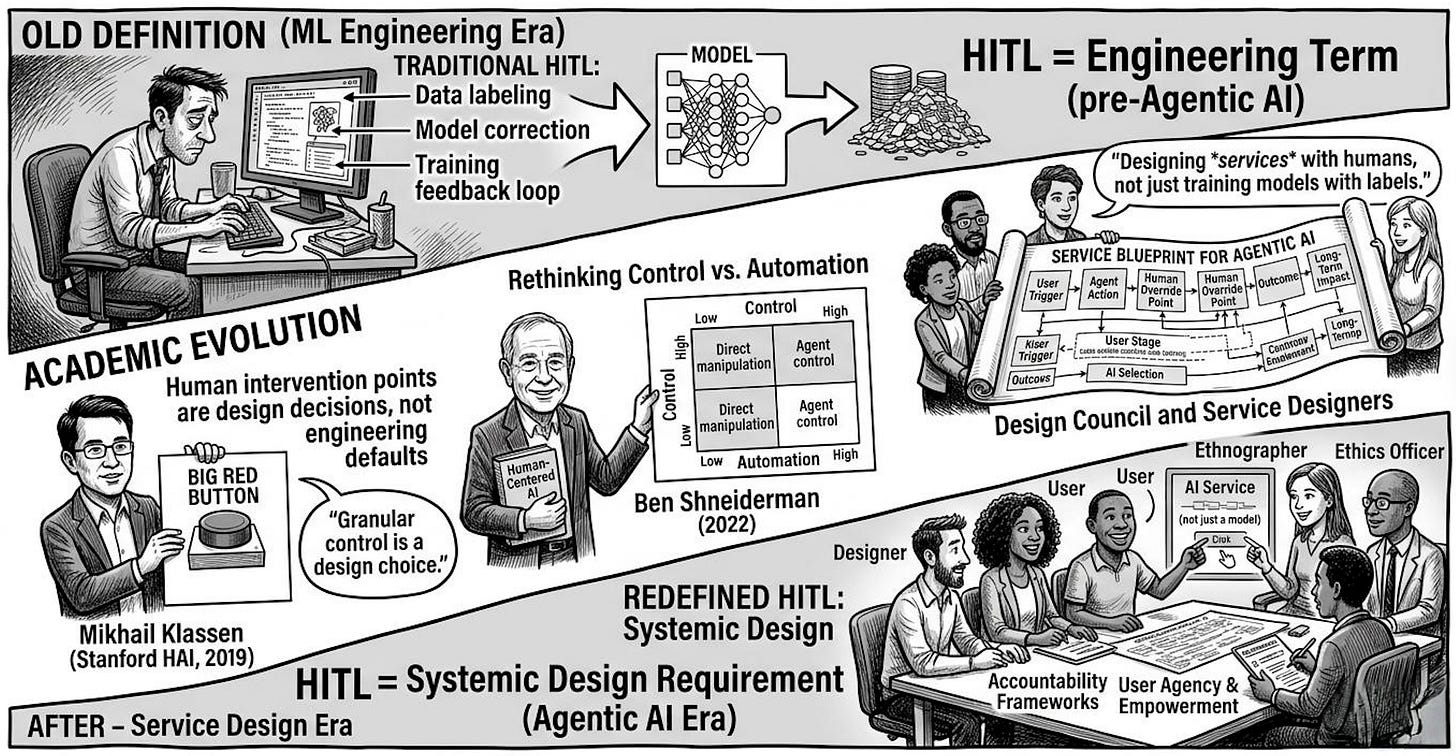

Human-in-the-Loop 重定義—從工程術語到服務設計責任

人在迴圈中(HITL)原本是機器學習(ML)工程術語,意指人類標注資料與修正模型。但在 Agentic AI 時代,它必須被重新定義為「在服務旅程的哪個節點、由誰、帶著什麼資訊做判斷」。這是服務設計師的問題,不只是工程師的問題。

Mikhail Klassen 與 Stanford HAI(2019)的奠基文章把「大紅按鈕(big red button)」比喻為顆粒化控制,指出人類介入點本身是設計決策,不是工程預設值。Ben Shneiderman 在《Human-Centered AI》(2022)中提出「reliable, safe, and trustworthy AI」需要明確的人類授權節點,而不是事後監看。他的框架在 UX 圈影響力正在上升—Frank Spillers 等人的服務設計討論都直接援引他。

【備註】 Frank Spillers 為 Experience Dynamics 創辦人、UX 與服務設計顧問;Darren Yeo 為 UX Collective 撰稿者。兩人皆為服務設計實踐者,將 Shneiderman 的學術框架轉化為可操作設計,人物簡介見文末附錄。

Spillers(2026)從服務設計視角提出了雙重核准設計:先授權意圖、再確認執行。這直接對應第二篇(私銀)的核心問題:客戶在一般金融資產配置和加密貨幣短期變現之間切換時,Agent 沒有辦法謹守界線。它不知道「這個建議屬於受監管的投資顧問行為」還是「這只是加密貨幣的資訊提供」。如果在服務旅程的設計階段就導入雙重核准—第一步確認意圖(「你想做的是查詢還是交易?」),第二步確認執行(「這筆操作涉及受監管資產,需要理專覆核」)—受託邊界就不會模糊。

Darren Yeo(2025)在 UX Collective 發表的 “How to Be the Designer in the AI Loop” 從標題就點明了這個轉向:設計師不只是為 AI 畫介面,而是要決定人在迴圈中的位置。全文為付費內容,但其主旨與 Shneiderman、Spillers 的方向一致—人在迴圈(HITL)不是工程師的附加功能,而是服務設計的核心決策。

第二篇的受託邊界問題,本質就是 人在迴圈(HITL) 設計從未被納入 服務藍圖(service blueprint) 的受託責任層。理專的角色不是被 Agent 取代,而是被重新定位為「高風險節點的人類簽核者」。但如果 服務藍圖(service blueprint) 裡根本沒有畫出這些節點,理專就會被擠到邊緣,變成事後補救的消防員。

Accountability Architect—UX 從介面設計者變成責任結構設計者

隨著 AI Agent 進入金融服務,UX 設計師的角色邊界正在擴大—從設計介面到設計責任結構。但多數 UX 實踐者還沒意識到這個角色轉變,業界也沒有給這個角色命名與配套工具。

Anthony Franco(AI First Principles 創辦人)在 UX Magazine(2025)發表的 “The AI Accountability Gap” 中提出三層問責模型:Operational / Strategic / Executive。UX 團隊長期只做 Operational 層(介面好不好用),Strategic 層(這個功能該不該上線)和 Executive 層(出事了誰負責)都被留給法遵與工程。三層斷線的結果,就是前三篇描述的每一個失敗。

Victor Yocco(UX 研究總監、Allelo Design)在 Smashing Magazine(2026 年 2 月)發表的 “Designing for Agentic AI” 更直接,把角色拆分寫清楚:UX Research 負責 信任校準(trust calibration)、Engineering 負責 logging 與 undo、PM 負責 升級政策(escalation policy)。這是目前社群最接近「Accountability Architect」概念的完整框架。Yocco 在文中寫了一句精準的區分:「Autonomy is an output of a technical system. Trustworthiness is an output of a design process.」—自主性是技術系統的產出,可信度是設計流程的產出。

回到第三篇(內部組織)。那篇提出的 policy_to_prompt_registry 與 human_signoff_checkpoint,就是 Accountability Architect 角色的具體工具清單。但問題是:在多數組織裡,沒有人的職務說明(job description)包含「確保政策條文被正確映射到 Agent 指令」這件事。這個責任落在法遵和工程之間的灰色地帶,而 UX 團隊—最有機會在服務藍圖(service blueprint)階段發現前後台斷點的角色—通常不被邀請參與這個層級的設計。

這不是能力問題,是角色定義問題。UX 團隊的設計對象必須從「介面」擴展到「責任結構」,否則前三篇描述的斷裂會持續發生。

{合作廣告}

🧑🎓 UX 訂閱制學習計劃:把 human-in-the-loop 變成你的日常。這也是我會特別推薦 #UX訂閱制學習計劃 的原因:它不是一次性的 bootcamp,而是把借位、補位、入位拆開來,串成 3 月到 12 月的一條學習軸線。透過每月 Podcast 和專欄,先向不同領域的 UX / 產品 / AI / 服務設計講師「借位」

透過直播與 Circle 社群討論,在你的真實案子與問題上進行「補位」

Agentic Bypass—當 Agent 繞過人類判斷節點

當 Agent 介面設計過於流暢,使用者在「慣性授權」下逐步讓渡決策權,而系統沒有任何機制提示風險等級的變化。這個現象需要一個精確的名字。