哈米尼刺殺報導教我們的事:公眾 AI 素養的「基礎設施視角」

What the Khamenei Assassination Report Teaches Us: The "Infrastructure Lens" of Public AI Literacy

序言

讀完《金融時報》Inside the plan to kill Ali Khamenei,我最震撼的是「誰在為這場暗殺提供建築學」。德黑蘭的交通監控、滲透的通訊基地台、演算法驅動的「生活模式」分析—一整套數據基礎設施在運轉,不是特工傳奇。同一套邏輯,在 Meta 眼鏡上,把公共空間變成「被標註的資料庫」。公眾 AI 素養的缺口:看不見這些個案背後共用的基礎設施。

這週有朋友還困在杜拜帆船酒店,中東戰事升級後航班取消、陸路封鎖,一時脫不了身。慰問的同時,我腦子裡轉的是:杜拜被捲入戰火,不是意外—精準打擊的佈局早就鋪好了。多年監控、演算法標註、觸發事件決定攻擊時機,FT 那篇哈米尼報導把這條鏈攤開給你看了。

而同一套「誰在被標註、標註後流向哪裡」的邏輯,在上一篇〈Meta Ray-Ban 智慧眼鏡〉裡,我們已經拆過:你的臉、聲音、行為,被送進肯亞標註,餵養 Llama。戰場上的精準打擊,和消費品裡的隱私災難,共用同一套基礎設施。這篇延續 Meta 眼鏡的討論,從 FT 報導切入,談公眾 AI 素養該補上的那一塊—為什麼我們總是「個案憤慨、結構失明」。

報導摘要:Inside the plan to kill Ali Khamenei

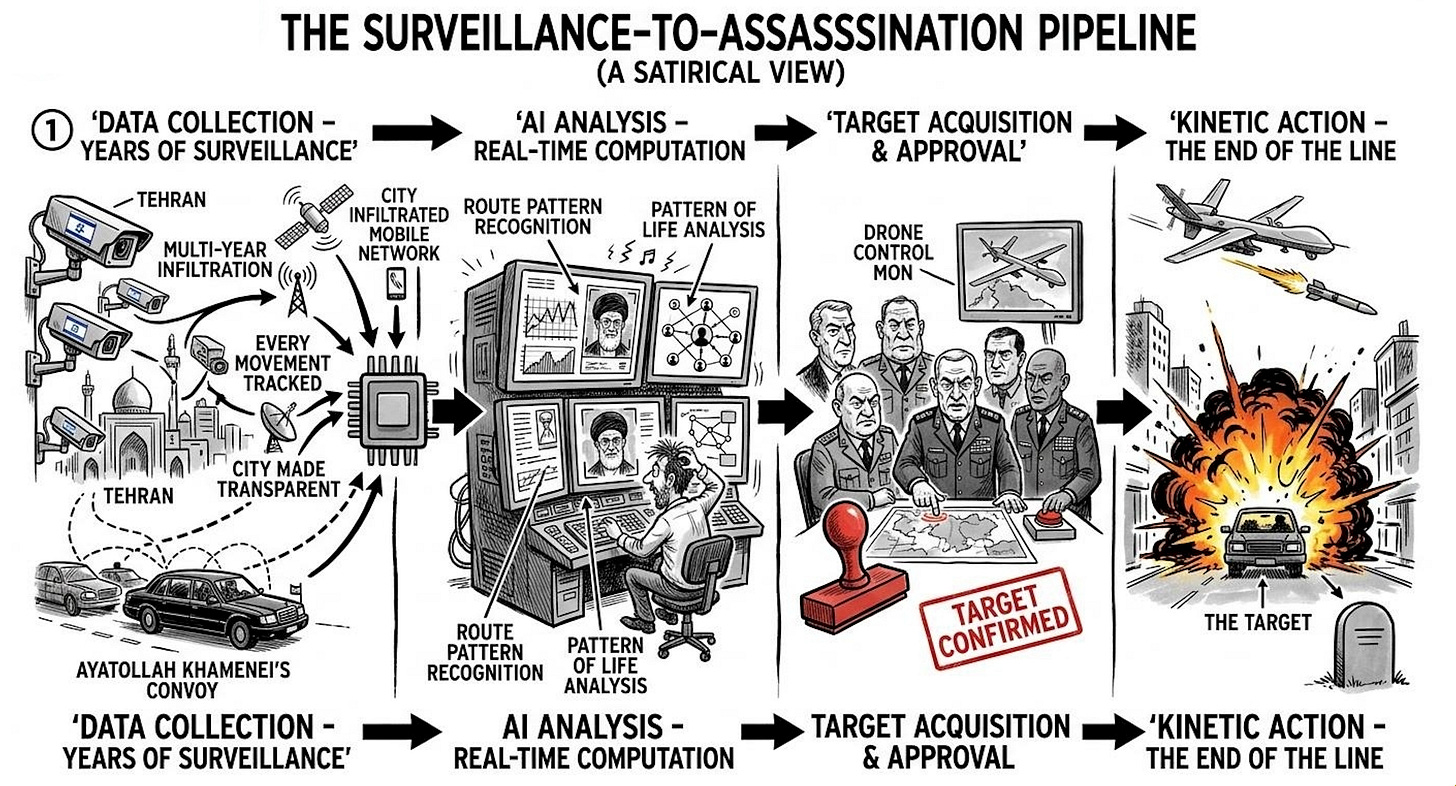

《金融時報》2026 年 2–3 月發布的長篇調查,以「Operation Midnight」為核心,重建美國與以色列為刺殺伊朗最高領袖哈米尼(Ayatollah Ali Khamenei)所策劃的多年情報與軍事行動。報導不只描述一場空襲,而是從「多年監控 → 即時演算 → 決策機制 → 執行與後果」完整呈現「城市監控+AI 情報 × 定點清除」的戰略鏈。

數據採集:以色列多年駭入德黑蘭的交通攝影機,監控哈米尼衛隊的每日行車路線、停車習慣與警備換班時間。這些畫面與滲透的行動通訊網路、衛星影像、人體資產情報,一併送入以「社會網路分析」(social network analysis)為主的演算法,用於即時辨識關鍵人物何時出現在何地。

執行:以色列派出戰機與飛彈,在短時間內對哈米尼所在建築群投下約三十枚精準炸彈,目標是在 60 秒內完成清除。愛爾蘭時報標題點出本質:「Years of surveillance, minutes of execution」—多年監控,數分鐘執行。

後果:美國情報界評估,即便成功刺殺,伊朗將由更極端的 IRGC 高層接班,刺殺並非終局。報導的價值在於把「數據基礎設施」攤開:德黑蘭不是被「監控」,是被「透視」。

德黑蘭的「透明城市」與你客廳的「被標註資料庫」

以色列情報機構用多年入侵的交通監控、演算法驅動的「生活模式」分析,把德黑蘭變成一座「透明城市」;Meta 眼鏡用 AI 即時辨識,把佩戴者與被拍者的臉、聲音、行為送進肯亞標註,餵養 Llama。差異只在「被標註的對象」—一個是目標,一個是訓練資料—監控的邏輯是同源的。

FT 報導揭露,「追蹤哈米尼」早年是手工篩選、人工目視確認的西西弗斯苦工;近年以色列的演算法驅動採集系統已將此大幅自動化。目標不再需要被「直接監控」—只要追蹤他身邊人的通勤、停車、值班時間,就能推算出「他在哪裡、何時在、跟誰在一起」。這就是「生活模式」(Pattern of Life)分析:人被當成網路中的節點,演算法自動標示誰是「高價值目標」。

Meta 眼鏡做的是同一件事,只是場景換了。鏡頭對著「被拍者的臉、行為、聲紋」,演算法在算「誰在畫面裡、該怎麼標註」。肯亞的 Sama 員工逐幀標註,這些資料進入 Llama 的訓練集—被拍者從未同意,但他們已經是「被標註的節點」。

兩種「被監控」共享同一結構:演算法自動標示 + 被標示者不知情。公眾把 Meta 眼鏡當「隱私醜聞」、把哈米尼刺殺當「地緣政治」—分開看待,就永遠看不到背後的數據工程化邏輯。

公眾 AI 素養的缺口:個案憤慨 vs 結構辨識

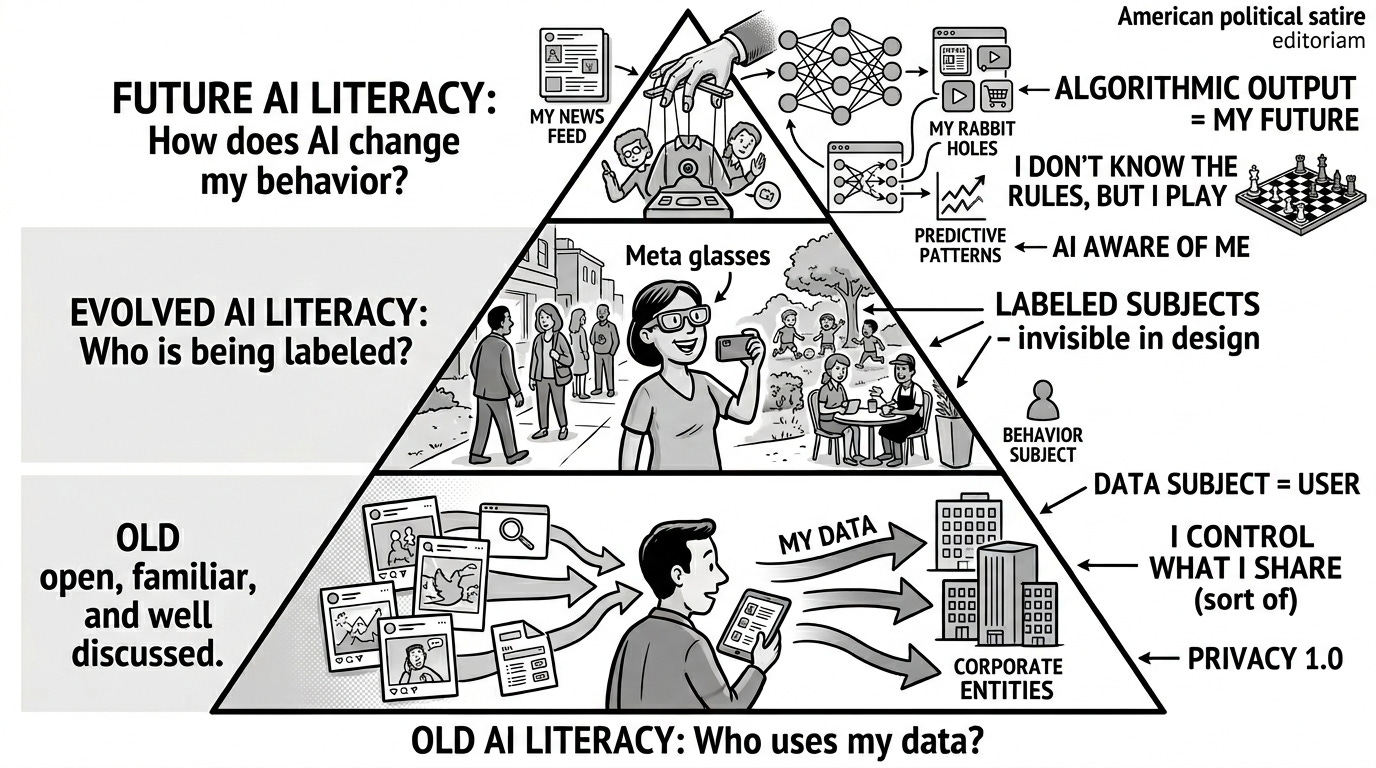

公眾 AI 素養的核心,是能辨識「這個醜聞和那個醜聞共用同一套基礎設施」。缺乏基礎設施視角,我們會不斷重複「震驚 → 抵制 → 遺忘」的循環,而下一款 299 美元的監控器照樣上市。

前幾篇文章已經指出:媒體素養 ≠ AI 素養。教孩子「不要被陌生人拍」是媒體素養;教孩子「你的臉被拍之後會去哪裡、被誰用、用多久」才是 AI 素養。但還有一層:就算個人懂得查 App 權限、讀條款,若無法把「Meta 眼鏡」「哈米尼監控」「人臉辨識」連成一條線,我們還是會把每個醜聞當成「又一次科技公司搞砸了」。

FT 報導中有一段制度設計:以色列軍方要求「兩名高階軍官獨立確認目標在現場」才能授權攻擊。看似是人的把關—但實務上,底層已被演算法「預先過濾」與「標示」,人的「確認」只是對機器輸出的再確認。

這和 Meta 眼鏡的「我們有 LED 燈、有隱私設定」如出一轍:表象合規,底層邏輯不變。公眾若只盯著「有沒有告知」「有沒有同意」,而不追問「誰在標註、標註後流向哪裡」,就會被表象安撫。

素養缺口的具象化:我們擅長對單一事件表達憤怒,卻不擅長追問「這件事和上週那件事,是不是同一套系統的不同輸出」。哈米尼報導的價值,正在於它把「數據基礎設施」攤開給你看—德黑蘭不是被「監控」,是被「透視」。我們的公共空間、校園、地鐵,也正在被同一類透視邏輯覆蓋,只是多數人還沒學會用這個視角看。

從「誰在拍」到「誰在被標註」:誰有權把誰變成節點?

AI 素養的下一階,是從「誰在用我的資料」升級為「誰在被標註、標註後成為什麼」。Meta 眼鏡的佩戴者是「使用者」,被拍者是「被標註者」—後者在設計中不存在,但他們才是數據流裡真正的節點。

上一篇「深度追問」已點出:被拍者沒有「同意」的選項,他們在 AIPET 架構中完全缺席。哈米尼報導把這個結構推到極端:哈米尼本人不需要被「直接追蹤」,他身邊的每個人—安保、司機、隨行—都是演算法眼中的「可追蹤節點」。標註他們,就能推演出「超級節點」的位置。

制度設計的對照:在 Meta 眼鏡中,「被拍者」的臉、聲音、行為,成為 AI 模型的「生活模式」資料;在以色列對哈米尼的監控中,「安保人員」的「通勤、停車、值班時間」,成為「目標預測」的資料。兩種「被監控」都建立在「演算法自動標示」與「被標示者不知情」的基礎上。

差異在於:Meta 眼鏡中,被標示者(被拍者)在設計中完全不存在;以色列情報系統中,被標示者(安保人員)是「被監控的節點」,只是目標不同。這提醒我們:在一個被演算法標註的時代,「被標示」的風險不只在戰場,而是在校園、地鐵、咖啡店,甚至在你家裡的客廳。

孩子的臉被 Meta 眼鏡捕捉,成為訓練資料;哈米尼的安保被以色列監控,成為目標預測的輸入。兩者都是「人 → 節點 → 資料」的轉換,差別只在終端用途—廣告、模型訓練、或是定點清除。

公眾 AI 素養若停留在「我該怎麼保護自己的資料」,就永遠看不見「別人的資料怎麼被用」。哈米尼報導強迫我們面對:當你戴著 Meta 眼鏡走過咖啡店,你周遭的每個人都在不知情的情況下,成為你眼鏡「視野」裡的節點。這不是隱私問題,是誰有權把誰變成節點的權力問題。

{合作廣告}

🧑🎓 UX 訂閱制學習計劃:把 human-in-the-loop 變成你的日常。這也是我會特別推薦 #UX訂閱制學習計劃 的原因:它不是一次性的 bootcamp,而是把借位、補位、入位拆開來,串成 3 月到 12 月的一條學習軸線。透過每月 Podcast 和專欄,先向不同領域的 UX / 產品 / AI / 服務設計講師「借位」

透過直播與 Circle 社群討論,在你的真實案子與問題上進行「補位」

橫向連結、節點追蹤、同盟辨識

Keep reading with a 7-day free trial

Subscribe to AI 素養與隱私體驗 to keep reading this post and get 7 days of free access to the full post archives.