[300 篇目標達成] 東數西算的 AI 世界不是平的:五個現實,亞洲父母已讀未回的教育焦慮

The World Is Not Flat. It Runs on Someone Else’s Computer.

引言:世界變平了嗎,還是只是介面變平了?

二十年前,美國記者湯瑪斯.佛里曼(Thomas Friedman)出版了一本改變全球商業想像的書:《世界是平的》。他的核心命題很簡單—科技讓資訊自由流動,讓印度工程師、孟加拉成衣廠、台灣電子業站上同一個競爭平台,讓地理不再是命運。

這個比喻統治了一整個世代的商業教育。

2026 年,讓我們打開帳單,算一算這個比喻現在值多少錢。

這個月,幾則看似無關的科技新聞,同時指向同一件事:全球 AI GPU 算力高度集中;中國用「東數西算」把算力變成國家工程;AI 釣魚攻擊開始把社交工程自動化;OpenAI 的通報門檻引發跨國安全爭議;紅杉資本把下一個萬億美元機會押在「用 AI 直接承包整個服務業工作」上;東南亞資料中心投資暴增,卻多半仍由美中科技巨頭推動。

這些新聞不是同一類事件,但可以收斂成五個現實:

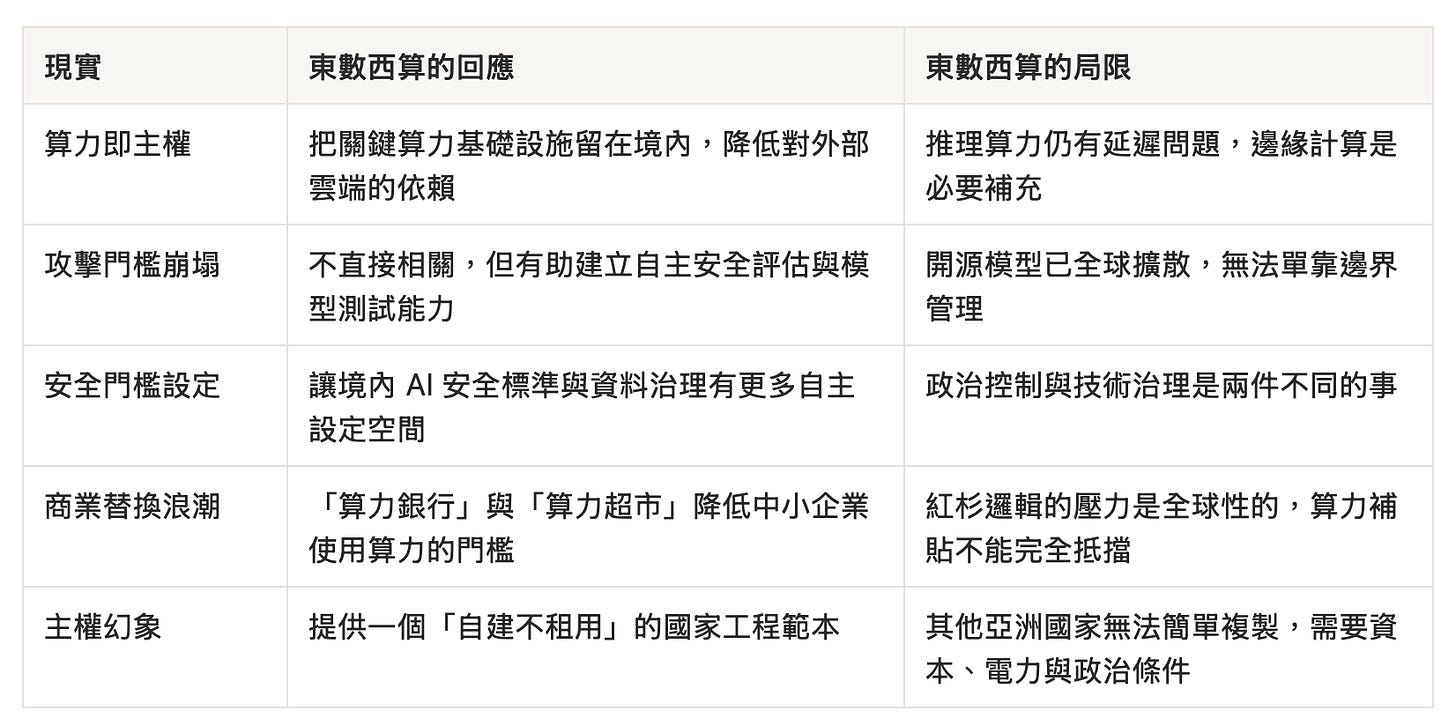

算力即主權:誰掌握 GPU、資料中心與電力,誰就掌握 AI 發展的底層條件。

攻擊門檻崩塌:模型讓個人化攻擊從昂貴行動變成接近零成本的規模化作業。

安全門檻設定權外移:什麼叫危險、什麼時候該通報,正在由少數平台替全球使用者定義。

商業替換浪潮:AI 不只取代任務,而是開始重寫服務業的定價與交付模式。

主權幻象:使用介面看似民主化,但基礎設施、資本與規則制定權仍高度集中。

這五個現實,共享一條底層斷層線:

AI 並沒有讓世界更平。它讓某些人以前所未有的速度掌握更多,並把這件事,包裝成民主化的禮物。

作者補充:最近我和一位已經移民到北美的創業朋友聊到下一代的教育路徑。話題本來很日常:孩子要不要提早接觸 AI?該在北美一路扎根,還是保留回亞洲、甚至看中國機會的可能?

聊著聊著,問題突然變得不日常了。

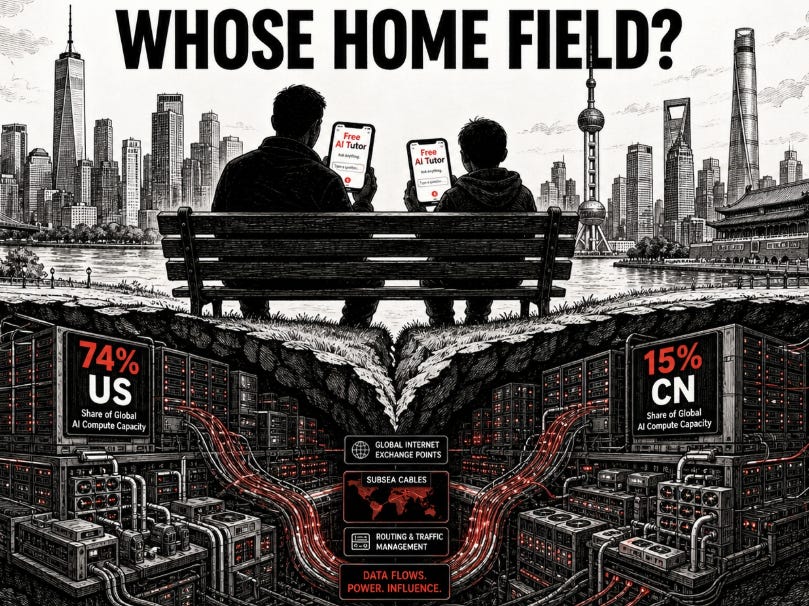

他說:「你看,北美有模型、有公司、有資本,小孩如果在這裡長大,至少是在主場。」

我回他:「可是主場是誰的主場?如果底層算力、模型 API、教育工具都在幾家公司手上,小孩只是比較早學會租用別人的主場。」

他停了一下,反問我:「那你覺得中國那套比較好?東數西算把算力留在境內,但規則更集中。你真的希望孩子進到那個系統裡?」

這句話我答不出來。因為我們家的路徑是先有中國經驗,再來到北美;他的路徑剛好相反,是先在北美扎根,再回頭看中國與亞洲機會。我們看的是同一張地圖,但站的位置不同。

最後我們沒有結論。只有一個很父母心的共識:下一代不是在選哪個國家比較先進,而是在選自己未來要依賴哪一套基礎設施、哪一套規則、哪一種失去選擇時的備案。

算力即主權—你的國家有沒有自己的電腦?

我們聊到孩子未來如果走生醫、AI 醫療或基因研究,第一道門檻可能不是他夠不夠聰明,而是研究團隊有沒有算力。

日本、台灣、韓國的大學實驗室都可能有好題目、好資料、好研究員,但訓練大型模型時,還是要排隊租美國或中國雲端服務商的 GPU。

下一步很可能不是「亞洲研究變弱」,而是研究路徑被迫改寫:更多團隊放棄從頭訓練,改做微調、API 包裝、資料合作,真正的底層模型留在少數算力平台手上。

這不是科幻。這是現在的結構,只是沿著現有軌跡走出來的近未來。

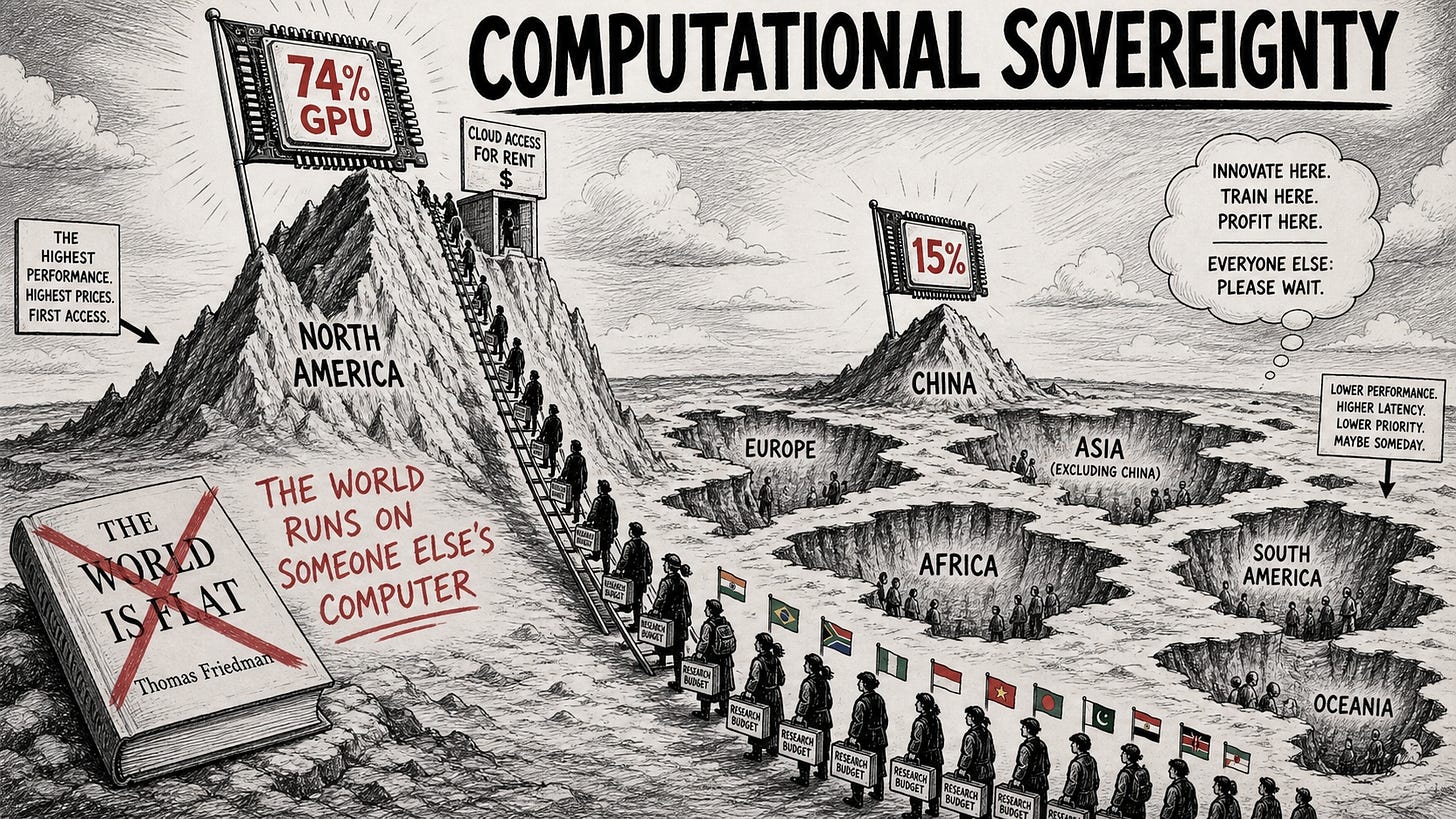

目前,已知的全球 AI GPU 叢集算力分布是:美國約佔 74-75%,中國約 14-15%,歐盟約 4-5%,其他全世界加起來大約 5%。 不是鐵幕時代,不是物理封鎖,但這份清單的意義,比任何核武擴散條約都更日常、更難反制。

更深一層的問題,在於這些算力的所有者不是各國政府。2019 年,公共部門—政府與學術機構—持有全球約 60% 的 AI 超算資源。到 2025 年,這個比例倒轉:約 80% 的算力掌握在少數私人科技巨頭手裡,公共部門僅剩約 15%。

這意味著什麼?

意味著多數亞洲公共研究機構,即使有頂尖人才,也很難單獨負擔一次 GPT-4 規格等級模型的完整訓練成本。不是他們不聰明,不是他們的研究員不努力。是他們沒有足夠大的電腦。

有人會說,可以租雲端算力。可以。但租用的代價不只是美金,而是資料主權被放進外部供應商、雲端區域、合約條款與司法管轄權共同構成的框架裡。你的醫療紀錄、你的語言模型、你的基因庫,不再只是「放在哪裡」的問題,而是誰有權設定它被處理、被審計、被暫停、被漲價的條件。

算力是新石油,但這次連石油勘探的工具,都不在你手上。

東數西算—把電腦搬回境內,權力就回來了嗎?

但這裡有一個容易誤判的地方:如果算力不要集中在少數城市、少數資料中心,而是分散到更便宜、更有電力的地方,問題是不是就解了?

中國的「東數西算」提供了一面很好的鏡子。它不是科幻,而是一個已經啟動的國家級工程:東部出需求,西部出土地、電力與資料中心。從基礎設施角度看,這是少數真正試圖把算力從核心城市往外移動的案例。2022 年,國家發改委等部門同意在京津冀、長三角、粵港澳大灣區、成渝、內蒙古、貴州、甘肅、寧夏啟動八大國家算力樞紐,並規劃十大數據中心集群。

但它也提醒我們:算力的物理分散,不等於權力的治理分散。

兩個家長都看過的產業切片:

我們都看過類似的產業訊號:AI 穿戴裝置、即時翻譯耳機、AI 助教、健康監測 App,正在把「思考輔助」變成雲端服務。

現在它看起來只是效率工具:幫孩子查資料、幫醫生整理病歷、幫工程師提示下一步。

但下一步會更敏感:當這些工具從「回答問題」變成「預測你要問什麼」,人會越來越少練習自己形成問題。

到那時,真正的風險不只是伺服器斷線,而是孩子、醫師、工程師都已經習慣把「先問什麼」交給系統決定。輔助輪還在時很舒服,拿掉時才知道自己多久沒踩踏板。

東數西算最直接的啟示,是距離沒有消失。訓練任務可以西移,因為它對延遲沒有那麼敏感;但推理任務、金融交易、自駕車、即時推薦、語音互動,都需要靠近使用者。你可以把大腦的訓練放到遠方,但眼睛、手、耳朵的反應時間仍然被物理世界限制。算力分散化不等於全面去中心化;訓練可以離開城市,推理仍必須靠近人。

第二個啟示,是電力不是背景成本,而是算力主權的硬籌碼。西部資料中心之所以有吸引力,不只是土地便宜,而是水電、風電、太陽能與冷卻條件可以降低長期運作成本。但可再生能源也有季節性,電網也有壓力,極端氣候會把「便宜」變成「不穩」。

誰能掌握穩定、低碳、可預期的電力供應,誰才真正握有 AI 基礎設施的長期籌碼。

第三個啟示,也是最容易被忽略的一個:物理去中心化,不等於治理去中心化。東數西算讓伺服器分散到更多地區,但電力配給、骨幹網路、資料規則、算力調度仍然高度依賴中央規劃。這和美國模式形成鏡像:美國的資料中心可能由多家公司分散建設,但標準、價格、可用性與模型供應鏈,仍由少數私人巨頭控制。

所以問題不是「集中」或「分散」這麼簡單。真正要問的是:誰能決定算力在哪裡、電力從哪裡來、延遲可以接受到什麼程度、使用者失去輔助時誰負責。

把這面鏡子放回本文的五個現實,可以看到東數西算不是答案本身,而是一種「國家級回應」:它確實回應了部分基礎設施問題,但也暴露出新的限制。

而當算力與模型逐漸外溢到更多人手上,下一個問題就不是「誰有電腦」,而是:誰會先把這台電腦變成武器。

AI 武裝了誰—攻擊門檻崩塌後,弱者先被打穿

兩個家長都看過的產業切片:

北美和亞洲的創業圈都看過這種事:小型律所、會計師、地產經紀、保險業務員,公開資料多、客戶關係深、防禦資源卻薄。

過去針對他們的詐騙需要人工研究。現在 AI 可以讀 LinkedIn、公司網站、研討會影片、法院紀錄,幾分鐘內生成一封像熟人寫來的信。

下一步不是「更多垃圾郵件」,而是中小專業服務業會變成攻擊跳板。攻擊者不需要直接打大公司,只要打下它的律師、會計師、顧問或外包商。

Wired 記者 Will Knight 今年 4 月親歷的那場模擬測試,呈現的正是這種結構性的危險。 不是技術的突破,而是攻擊的成本曲線崩塌。

SocialProof 執行長 Rachel Tobac 說的那句話,值得貼在每個資安培訓課程的第一頁:「我不認為 AI 讓攻擊更具說服力,但它讓一個人能夠把攻擊規模放大十倍、百倍。殺傷鏈正在全面自動化。」

數字更直接:傳統大量釣魚郵件的點擊率約 12%;高度個人化的 AI 釣魚攻擊,在某些測試場景可達 54%。 差距不是優化,是質變。

這件事的地緣政治意涵,被大多數亞洲媒體忽略了。DeepSeek-V3 在那場 Wired 實驗裡被點名為表現最流暢的「攻擊模型」。 但這裡的重點不是「中國模型威脅美國記者」—重點是開源模型讓任何人都可以把攻擊武器的邊際成本壓到趨近於零。

非國家行為者。競爭對手。詐騙產業。政治組織。情報機構。他們全都可以用同樣的工具。

亞洲的矛盾在於:許多亞洲國家是 AI 工具的高密度使用地,卻不是 AI 安全標準的制定者。當攻擊能力民主化,防禦能力卻需要算力、資料、以及制度建設—而這三樣,全部指向本章第一節的那份清單。

誰定義危險—安全門檻其實是法律文化的出口

兩個家長都看過的產業切片:

我們身邊已經有孩子把 AI 當成作業助理、情緒出口、甚至半個朋友。這不是科幻,是很多家庭正在發生的日常。

現在平台會說它有安全政策:危險內容會被標記,極端風險會被升級,某些帳號會被封禁。

但下一步一定會碰到更難的問題:孩子在深夜對 AI 說「我不想活了」,這是求救、玩笑、情緒語言,還是真正的威脅?

如果平台不通報,出事誰負責?如果平台過度通報,誰的隱私與信任先被犧牲?家長想要安全,但孩子也需要一個不會立刻把自己交出去的求助空間。

加拿大 Tumbler Ridge 槍擊案揭示的核心問題,不是 OpenAI「失職」,而是一個更根本的困境:到底誰有資格設定這道門檻?

OpenAI 的通報門檻是「迫在眉睫且可信的嚴重人身傷害威脅」(imminent and credible risk of serious physical harm)。 這個標準是由 OpenAI 內部的安全、法律與政策團隊制定的,適用於全球所有用戶,包括印尼的年輕人、台灣的高中生、香港的上班族,以及加拿大卑詩省的 18 歲少年。

帳號被封禁了,但訊號沒有傳遞出去。八個月後,八個人死了。

道歉信解決不了:

「即時且可信的嚴重人身傷害威脅」—這個通報標準,是 OpenAI 內部的安全、法律與政策團隊制定的,沿用了美國的隱私法律文化,適用於全球每一個說話的人,卻沒有任何跨國民主問責機制。

這裡有一個關鍵的文化不對稱問題。「即時威脅」的定義,嵌入了設計者的社會情境。馬來西亞的政治反對語言、台灣的兩岸情緒表達、香港的示威敘事、印度的宗教衝突語境—誰來評估它們的「威脅閾值」?誰有資格?

如果放寬通報標準,那個雅加達的年輕人就是代價。如果不放寬,Tumbler Ridge 的八條命就是代價。這道選擇題,根本不應該由一家私人公司獨自回答,更不應該只用一種文化的標尺衡量。

這不只是法律管轄權的問題,而是更深的一層:安全標準的設計地點,就是對「什麼是危險言論」的定義地點。算力在哪裡,訓練資料就在哪裡;訓練資料在哪裡,模型的價值判斷就在哪裡;模型的價值判斷在哪裡,安全門檻就在哪裡。東數西算試圖讓這條鏈的起點留在境內,道理正在這裡。

這聽起來像是通報標準太嚴格了。但那個印尼的場景同樣是真實的風險—放寬通報,誰的隱私先被犧牲?誰的「情緒語言」先被判斷為威脅?不同的文化背景,表達痛苦的語言完全不同。「我想死」在某些語境是真實的危機訊號;在另一些語境,是年輕人在群聊裡說「累死了我」。

問題不在於通報還是不通報。問題在於:這份判斷標準,是在矽谷的辦公室裡,由美國法律文化、美國的隱私觀念,以及美國的訴訟風險評估所設計的,卻施加在全球每一個說話的人身上,沒有任何跨國民主問責機制。

加拿大政府目前正在考慮立法規範 AI 平台的通報義務,並要求 OpenAI 與 RCMP 建立直接聯絡窗口。 這是一個開始。但一個國家能管到 OpenAI 的全球政策嗎?那亞洲國家呢?這道問題,就跟第一章的算力問題,本質上是同一件事:掌握基礎設施的人,也掌握了規則的設定權。

服務業被重新定價—AI 搶的不是工具預算,是工作預算

兩個家長都看過的產業切片:

我們都看過中小企業主身邊的那種專業服務:會計師幫忙報稅,保險業務員幫忙比方案,法務顧問幫忙看合約,供應鏈顧問幫忙找廠商。

這些人不是低技能勞工。他們是城市中產服務業的骨架,也是很多家庭以為「孩子考到專業證照就安全」的理由。

但下一步變化已經很清楚:AI 服務不再賣工具,而是直接賣結果。不是給會計師一個更快的軟體,而是對老闆說:「你不用找會計師,我直接幫你完成申報。」

這不是某個人不努力,而是整個產業的收費邏輯從「買專業時間」轉成「買完成結果」。父母替孩子想職涯時,不能只問哪個證照穩,還要問那個職業的交付物能不能被 AI 直接承包。

紅杉資本今年發表的〈Services: The New Software〉,用一個乾淨的算術點出了這件事的規模:企業每花 1 美元在軟體上,就有 6 美元花在對應的服務上。下一個萬億美元公司,不是做更好的工具,而是把工具那個 1 美元,換成直接承攬那 6 美元的工作。

這個論述從投資人視角看起來合理、美麗、邏輯閉合。但從勞動者的角度看,它描述的是:一場以資本為後盾的服務業替換行動,目標是把「外包出去的工作」從人力供應商換成 AI 供應商。

紅杉指出的幾個最大賽道,加起來都是數千億美元的市場:

保險經紀:比價與填表,高度標準化

會計與審計:結構性人才缺口,正在快速向 AI 傾斜

醫療收入循環管理:七萬個標準代碼,規則複雜,但終究是規則

供應鏈與採購:兩成不重要的尾端供應商沒人管,AI 去把被白白浪費的錢找出來

這些行業在亞洲中型城市是什麼?就是台北、首爾、吉隆坡、胡志明市的中產服務業:開事務所的人、跑業務的保險業務員、在中型企業做財務的人。這批人不是最脆弱的,但他們是「有一定技能、一定學歷、以為自己已經在安全地帶」的那群人。

所以 AI 時代的大學生,同時承受三件以前不存在的東西。

第一是知識落伍:課程更新速度遠比不上產業,四年學的東西可能兩年就過時。

第二是產業重組:原本「考到證照就安全」的職業,正是紅杉投資報告點名最快被 AI 服務替換的行業。

第三是職位消失:這不是未來式,而是現在進行式。他們還在念書時,那些實習機會、助理職缺、入門工作,已經開始被自動化流程吞掉。

這三層壓力疊在一起,「學業加創業」聽起來像解藥,實際上卻是把以前四年的試誤空間,壓縮進更短的時間窗口,而且要求的資源—算力、資金、人脈、心理韌性—本來就不是人人站在同一個起跑點。

這才是最危險的地方。

紅杉的論述裡有一個地方說得很直接:「副駕模式賣工具,自動駕駛模式賣結果。從第一天起,前者搶的是工具預算,後者搶的是工作預算。」 而自動駕駛原生公司之所以有窗口期,正是因為它沒有現有客戶的包袱—它不需要顧及被它取代的那批人的感受。

對亞洲中小企業主來說,還有另一重困境:要用這些 AI 服務,底層算力還是流經美國或中國的雲端。資料在哪裡、歸誰所有、怎麼被訓練進下一版模型,本質上都是第一章的問題的延伸。

{合作廣告}

🧑🎓 UX 訂閱制學習計劃:把 human-in-the-loop 變成你的日常。這也是我會特別推薦 #UX訂閱制學習計劃 的原因:它不是一次性的 bootcamp,而是把借位、補位、入位拆開來,串成 3 月到 12 月的一條學習軸線。透過每月 Podcast 和專欄,先向不同領域的 UX / 產品 / AI / 服務設計講師「借位」

透過直播與 Circle 社群討論,在你的真實案子與問題上進行「補位」

主權幻象—免費介面背後,是別人的電腦和帳單

兩個家長都看過的產業切片:

教育科技是最容易讓家長心動的場景:免費 AI 家教、個人化練習、作文批改、英文對話、升學建議,看起來都像是在縮小城鄉差距。

這件事是真的有價值。偏鄉孩子可以接觸更好的教材,移民家庭孩子可以更快補語言,老師也能少做一些重複工作。

但下一步會更尖銳:誰擁有孩子的學習資料?誰用這些資料訓練下一代教育模型?誰決定一個孩子「適合」走 STEM、藝術、技職,還是普通升學路徑?

當教育工具免費到像水一樣自然,父母最容易忘記問:這個水管是誰鋪的,水表記在哪裡。

最真實的主權幻象,不在思想實驗裡,而在馬來西亞目前的資料中心清單上。產業媒體估算,馬來西亞已有超過 500 座資料中心在營運、約 300 座正在興建,並且還有更多規劃案排隊。表面上,這是東南亞取得 AI 基礎設施入場券;但往下看,關鍵投資多半來自外資雲端、晶片與中國科技公司,GPU 授權、骨幹網路、雲端架構與基礎模型仍高度依賴境外。那個國旗插在資料中心屋頂上的圖景,不是隱喻,而是 2026 年的現實選擇:土地在本地,電力在本地,帳單與控制權卻未必在本地。

技術史有一個鐵律,幾乎沒有例外:每一波技術革命,初期看起來都是平等化的。廣播讓農村人聽到城市的聲音,網際網路讓任何人都可以發布內容,社群媒體讓每個人都有了擴音器。

然後大家發現,廣播的播送頻率是特許執照,網際網路的骨幹是幾條海底電纜,社群媒體的演算法把話語權集中到了少數幾個人和幾個平台。

AI 的「民主化」說法,現在正在走這條路的初期階段。

使用介面層的那一片,確實是平的:你在河内和紐約可以用同一個 ChatGPT,用同樣的功能,打同樣的問題。 這是真的。

但基礎設施層的那一片,比任何時代都更不平:

算力集中在幾家公司幾個國家的資料中心裡

安全標準由這幾家公司的法務文化決定

商業利潤流向掌握基礎模型與資料管道的那方

訓練資料的來源—包括那個東南亞老師的課堂—免費流入了模型,卻沒有任何議價能力

「地緣 AI(Geo-AI)」這個框架,正在被越來越多的分析者用來描述這個現象:AI 的發展路線不是中性的技術演進,而是地緣政治的行動。 美國的 AI 行動計畫、中國的算力自主建設、歐盟試圖用《AI 法案》換取定義規則的話語權,每一步都是在搶答同一個問題:到底誰來設定這個時代的技術邊界,也就是商業規則、安全標準、資料主權的邊界?

對日本、韓國、台灣、東南亞這些「在技術層面深度參與但不掌握核心算力」的地區來說,這個問題沒有輕鬆的答案。它不是「跟美還是跟中」的二選一,因為那只是換一個被設定門檻的對象。真正的問題是:在這場基礎設施的所有權戰爭裡,亞洲有沒有任何辦法確保自己的資料主權、自己的安全標準設計權,以及自己的公民不被他人設計的門檻誤傷的能力?

結語:真正的 AI 素養,是看懂誰擁有基礎設施

讓我們回到最初的問題:世界是平的嗎?

使用者介面那一層,是的。 你可以和地球另一端的人用同一個模型、問同一個問題。這是真的,這很珍貴,不應輕蔑。

但資料中心那一層、安全標準那一層、商業利潤那一層—世界從來沒有這麼不平過。

這五個現實,不是各自的科技新聞,而是同一個故事的五個切面:

算力分布與東數西算,是基礎設施所有權上的不平等

AI 釣魚攻擊,是安全能力上的不平等

Tumbler Ridge 的門檻問題,是規則設定上的不平等

紅杉的商業地圖,是商業利潤上的不平等

東南亞資料中心與「AI 民主化」敘事,是主權幻象上的不平等

作為亞洲讀者父母,在接受 AI 相關資訊時,有三個校正框架值得養成習慣:

第一,每一條「AI 讓世界更平」的說法,問:這說的是使用介面層,還是基礎設施層? 兩件事的方向幾乎相反。把它們混在一起,是這個時代最有效的認知操作。

第二,每一個安全政策、通報標準、內容審核規則,問:這是誰的法律文化在設計它? 規則不是中性的。它嵌入了設計者的社會情境。Tumbler Ridge 的門檻是美國隱私法律語境的產物,並不代表它適合馬來西亞、台灣、或印度的情境。

第三,每一個「AI 取代某職業」的預測,問:被取代的那批人在哪裡?他們的緩衝在哪裡?是誰在設計他們轉型的條件? 紅杉的投資邏輯是合理的,但投資人的理性與勞動者的緩衝時間,是兩個完全不同速度的事。

佛里曼的《世界是平的》,描述的是一個技術讓進入門檻降低的時代。

2026 年,進入門檻的確降低了—對使用者是的,對設定規則者從來不是。

新的數位鴻溝,不是有沒有網路,而是誰的電腦運算了世界,誰設定了什麼叫做危險,誰決定了哪些工作可以被取代。

如果你現在是亞洲的一個創業者、研究者、政策工作者、或者只是一個每天使用 AI 工具的普通人,這個問題的答案不在你那邊。

但知道這件事,是第一步。

那場關於下一代教育路徑的父母對話,最後沒有結論,只有一個共識:不管孩子最後落腳在哪裡,他需要的核心能力不是把哪套工具用得最熟,而是知道這套工具背後的電力從哪裡來、帳單記在誰名下、出了問題往哪裡投訴。這不是技術教育,是公民教育。而公民教育在 AI 時代,必須包含對基礎設施所有權的基本認識。

參考文獻

53AI. (2026). 紅杉資本 AI 峰會與服務業自動化賽道整理. https://www.53ai.com/news/shuziyuangong/2026040861347

21 世紀經濟報導. (2026). 「算力銀行」「算力超市」是啥?一文看懂核心要點. https://www.21jingji.com/article/20260403/herald/77b3a4428069a811bd72ab4fd0fcee36.html

EET China. (2022). 到底該如何看待「東數西算」?. https://www.eet-china.com/mp/a113584.html

EET China. (2022). 東數西算,網絡為先. https://www.eet-china.com/mp/a119285.html

Epoch AI. (2025). The US hosts the majority of GPU cluster performance, followed by China. https://epoch.ai/data-insights/ai-supercomputers-performance-share-by-country

Epoch AI. (2025). Private-sector companies own a dominant share of GPU clusters. https://epoch.ai/data-insights/ai-supercomputers-performance-share-by-sector

Feel Trading. (2026). AI phishing and cybersecurity risk report. https://feel.trading/en/news/ff9c001e69

HK01. (2026). OpenAI CEO 就加拿大槍擊案道歉:發現槍手違規活動後未有通報警方. https://www.hk01.com/即時國際/60343859/openai-ceo就加拿大槍擊案道歉-發現槍手違規活動後未有通報警方

iFeng. (2026). Services: The New Software 相關論述整理. https://i.ifeng.com/c/8snPnYlBuLa

ITSoLoTime. (2026). AI 算力與基礎設施集中化整理. https://www.itsolotime.com/archives/18790

Knight, W. (2026). 5 AI models tried to scam me. Some of them were scary good. WIRED. https://www.wired.com/story/ai-model-phishing-attack-cybersecurity/

Libertify. (2026). AI diffusion framework: US AI export controls. https://www.libertify.com/interactive-library/ai-diffusion-framework-us-export-controls-csis-analysis/

Libertify. (2026). AI safety report 2026: Global risks and governance. https://www.libertify.com/interactive-library/ai-safety-report-2026-global-risks-governance/

Linas. (2026). Sequoia’s “Services: The New Software” thesis will mint billionaires and bankrupt copycats.

Nikkei Asia. (2026). Malaysia’s data center capacity set to double by end-2026. https://asia.nikkei.com/business/technology/Malaysia-s-data-center-capacity-set-to-double-by-end-2026

NCSTI. (2022). 「東數西算」工程正式啟動:全國數據中心這樣布局. https://www.ncsti.gov.cn/kjdt/ztbd/xzjj/szjjrc/rcdsxs/202206/t20220606_81998.html

NCSTI. (2024). 10 個國家數據中心集群算力規模超 146 萬標準機架:「東數西算」提升國家整體算力. https://www.ncsti.gov.cn/kjdt/kjrd/qtrd_kjrd/202407/t20240723_172472.html

人民網. (2022). 「東數西算」:推動算力資源協同發展,助推數字經濟發展. http://theory.people.com.cn/n1/2022/0303/c40531-32364429.html

人民網. (2026). 探索「算力銀行」「算力超市」等創新業務. http://finance.people.com.cn/BIG5/n1/2026/0403/c1004-40694427.html

貴州省人民政府. (2022, February 21). 解讀:「東數西算」工程全面實施. https://www.guizhou.gov.cn/home/rdgz/202202/t20220221_72626531.html

遠見雜誌. (2026). AI 地緣政治與亞洲資料主權討論. https://www.gvm.com.tw/article/127411

科技新報. (2026). ChatGPT 帳號封禁與 Tumbler Ridge 槍擊案追蹤. https://technews.tw/2026/02/24/shooting-suspects-account-was-previously-banned-by-chatgpt/

科技政策研究與資訊中心. (2026). 地緣 AI 與國家 AI 行動計畫分析. https://iknow.stpi.niar.org.tw/post/Read.aspx?PostID=22481

QIIA. (2026). AI 工具全球使用與介面民主化討論. https://www.qiia.org/zh-hans/node/1832

Sing Tao Canada. (2026). AI 只是一個工具嗎?Tumbler Ridge 槍擊受害者狀告 OpenAI. https://www.singtao.ca/7447710/2026-03-17/news-【評論】ai只是一個工具嗎?圖布勒嶺槍擊受害者狀告openai/

Sing Tao USA. (2026). Altman apologizes after OpenAI failed to alert police before Tumbler Ridge killings. https://www.singtaousa.com/2026/04/25/news/world/altman-apologizes-after-openai-failed-to-alert-police-before-tumbler-ridge-killings/

Tech Wire Asia. (2026). Malaysia’s data centre policy: AI in, everything else out. https://techwireasia.com/2026/03/malaysia-data-centre-policy-ai-moratorium/

The Diplomat. (2025). Coded dependence: How China’s AI expansion is locking in Southeast Asia. https://thediplomat.com/2025/06/coded-dependence-how-chinas-ai-expansion-is-locking-in-southeast-asia/

Welcome AI. (2026). AI models enhance scam techniques, challenging cybersecurity strategies. https://www.welcome.ai/content/ai-models-enhance-scam-techniques-challenging-cybersecurity-strategies

Copyright © PrivacyUX Consulting Ltd. All rights reserved.

Joshua 是 Agentic UX(代理式使用者體驗)的先驅,在人工智能與使用者體驗設計領域擁有超過 15 年的開創性實踐。他率先提出將用戶隱私保護視為 AI 產品設計的核心理念,於 2022 年創立 Privacyux Consulting Ltd. 並擔任首席顧問,積極推動隱私導向的醫療 AI 產品革新。此前,他亦擔任社交 AI 首席策略官(2022-2024),專注於設計注重隱私的情感識別系統及用戶數據自主權管理機制。